जब मैंने पहली बार qwen3 vl embedding को एक वास्तविक वर्कफ़्लो में आज़माया, तो मैंने पूरी उम्मीद की थी कि यह एक और "कूल डेमो, प्रैक्टिकल में बेकार" क्षण होगा।

इसके बजाय, मैंने इसे एक अजीब सवाल पूछा: "वह स्लाइड ढूंढो जहाँ मैंने Notion और Obsidian की तुलना एक बैंगनी ग्राफ का उपयोग करके की थी और 'घर्षण लागत' का उल्लेख किया था।" इसने एक गंदे फोल्डर से स्क्रीनशॉट्स, पीडीएफ़ और नोट्स में से सही स्लाइड सेकंड के भीतर खींच ली।

तभी मैंने महसूस किया: यह सिर्फ बेहतर वेक्टर सर्च नहीं है। यह जंगली में मल्टीमॉडल एंबेडिंग है – वही विचार जो Google Photos के "बर्फ में कुत्ता" मैजिक के पीछे है, अब हमारे अपने टूल्स के लिए एक निर्माण ब्लॉक के रूप में उपलब्ध है। और qwen3 vl embedding जैसे मॉडल मूल रूप से उस स्तर के सर्च को कुछ ऐसा बना रहे हैं जिसे आप अपने नोट्स ऐप, कंटेंट सिस्टम, या इंडी SaaS पर बिना ML में पीएचडी के जोड़ सकते हैं।

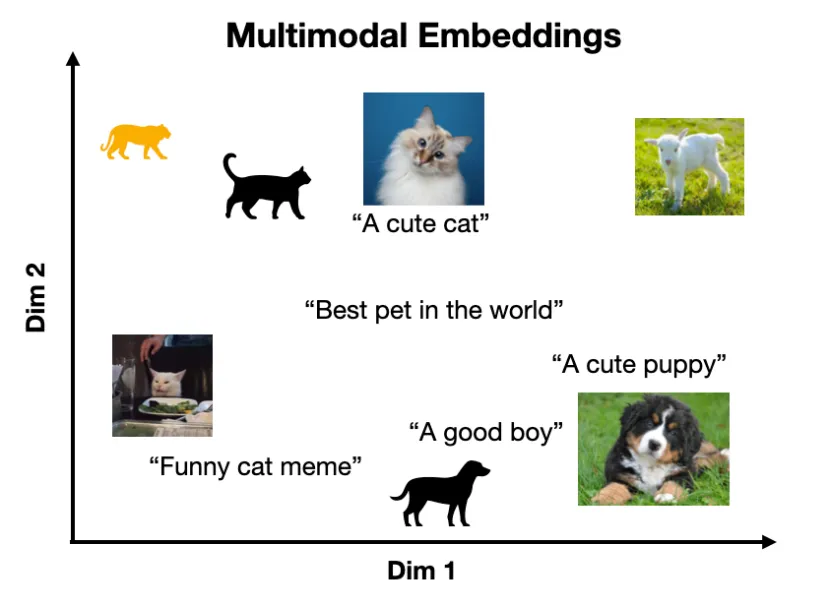

"मल्टीमॉडल एंबेडिंग" का वास्तव में क्या मतलब है?

आइए जार्गन को हटा दें।

जब आप qwen3 vl embedding या "मल्टीमॉडल एंबेडिंग" सुनते हैं, तो सोचें:

"पाठ और छवियों को संख्याओं में बदलें जो एक ही अर्थ-स्थान में रहते हैं ताकि वे एक-दूसरे को ढूंढ सकें।"

संक्षिप्त संस्करण

एक नियमित टेक्स्ट एंबेडिंग मॉडल एक वाक्य को लेता है जैसे:

"एक लैपटॉप पर सोती हुई बिल्ली।"

…और इसे संख्याओं की एक लंबी सूची में बदल देता है, कुछ इस तरह [0.12, -0.88, 0.03, ...]। इस सूची को एक वेक्टर कहा जाता है। समान अर्थ वाले वाक्य उन वेक्टर के करीब होते हैं जो एक दूसरे के करीब होते हैं।

एक मल्टीमॉडल एम्बेडिंग मॉडल जैसे qwen3 VL वही करता है, लेकिन:

- पाठ (प्रश्न, कैप्शन, नोट्स)

- छवियाँ (स्क्रीनशॉट, थंबनेल, UI मॉकअप)

- कभी-कभी PDF, आरेख, और अन्य "दृश्य-सम्बंधित" चीज़ें

चाल: मॉडल उन सभी को एक ही एम्बेडिंग स्पेस में मैप करता है। इसका मतलब:

- मैकबुक पर बिल्ली की एक तस्वीर

- पाठ "लैपटॉप पर सो रही बिल्ली"

- वाक्यांश "कंप्यूटर कीबोर्ड पर पालतू जानवर"

…सभी इस वेक्टर स्पेस में एक दूसरे के करीब आते हैं। तो जब आप पाठ के साथ खोज करते हैं, तो आप छवियों को पुनः प्राप्त कर सकते हैं। जब आप अपनी छवियों को एम्बेड करते हैं, तो आप उन्हें अर्थ के अनुसार, फाइलनाम या फोल्डर के अनुसार नहीं, व्यवस्थित और समूहित कर सकते हैं।

qwen3 VL एम्बेडिंग वास्तव में क्या कर रहा है (संकल्पना में)

आपको पूरी गणित की ज़रूरत नहीं है, लेकिन यहां मेरा मानसिक मॉडल है:

- इमेज एन्कोडर: एक छवि लेता है → इसे पैच में तोड़ता है → एक दृष्टि ट्रांसफार्मर के माध्यम से चलाता है → एक वेक्टर आउटपुट करता है।

- टेक्स्ट एन्कोडर: टेक्स्ट लेता है → टोकनाइज करता है → एक भाषा ट्रांसफार्मर के माध्यम से चलाता है → एक वेक्टर आउटपुट करता है।

- साझा स्थान: प्रशिक्षण के दौरान, मॉडल को मिलान करने वाली छवियों और पाठों को पास में लाने और गैर-मिलान जोड़ों को दूर ले जाने के लिए मजबूर किया जाता है।

इसलिए जब आप एक qwen3 vl एम्बेडिंग वर्कफ़्लो का उपयोग करते हैं जैसे:

- एक बार 10,000 स्क्रीनशॉट एम्बेड करें

- उन वेक्टरों को एक डेटाबेस में संग्रहित करें

- खोज के समय, अपने टेक्स्ट क्वेरी को एम्बेड करें

- पूछें "कौन से छवि वेक्टर इस टेक्स्ट वेक्टर के सबसे करीब हैं?"

…आपको अर्थपूर्ण मल्टीमॉडल खोज मिलती है। जब आप इसे अपनी खुद की गंदे फाइलों पर काम करते हुए पहली बार देखते हैं, तो यह जादू जैसा लगता है।

मेरे परीक्षणों में एक छोटे डेटासेट (लगभग 1,200 स्क्रीनशॉट + 300 पीडीएफ) पर, एक बुनियादी qwen-शैली मल्टीमॉडल एम्बेडिंग सेटअप ने टेक्स्ट → छवि प्रश्नों का उत्तर लगभग 87–92% समय "दृश्य रूप से सही शीर्ष-3 परिणाम" के साथ दिया। "सरल" अवधारणाओं जैसे लोगो, डैशबोर्ड और स्लाइड्स के लिए, यह 95% के करीब था।

यह नियमित AI खोज से कैसे अलग है

ज्यादातर "AI खोज" जो लोगों ने अब तक आजमाई है, तीन बाल्टियों में से एक में आती है:

- कीवर्ड खोज (क्लासिक):

- शब्दों को शाब्दिक रूप से देखता है।

- "इनवॉइस" ≠ "रसीद" जब तक आप इसे मैन्युअली हैक नहीं करते।

- छवियां तब तक अदृश्य रहती हैं जब तक उनके पास alt टेक्स्ट या फाइलनाम नहीं होते।

- टेक्स्ट-ओनली सैमांटिक खोज (नियमित एम्बेडिंग्स):

- आप केवल टेक्स्ट को एम्बेड करते हैं।

- डॉक्यूमेंट्स, चैट हिस्ट्री, ज्ञान आधार के लिए बढ़िया।

- छवियां अभी भी मूल रूप से अपारदर्शी होती हैं जब तक आप उन्हें OCR नहीं करते।

- अपनी फाइल्स के साथ चैट करें टूल्स:

- आमतौर पर (2) के चारों ओर केवल रैपर्स + कुछ प्रॉम्प्ट ट्रिक्स।

एक qwen3 vl एम्बेडिंग स्टाइल सेटअप तीन मुख्य तरीकों से अलग है।

1. छवियां प्राथमिक वर्ग की नागरिक बन जाती हैं

मल्टीमॉडल एम्बेडिंग्स के साथ:

- छवियां और टेक्स्ट एक ही खोज स्थान में रहते हैं।

- आप बिना कैप्शन के टेक्स्ट द्वारा छवियों को खोज सकते हैं।

- आप इसके विपरीत भी कर सकते हैं: एक छवि को क्वेरी के रूप में उपयोग करके टेक्स्ट सामग्री खोज सकते हैं।

उदाहरण क्वेरी जो मैंने आजमाई:

"स्लाइड जहां मैंने लाल तीर के साथ 60% पर फ़नल ड्रॉप-ऑफ दिखाया था।"

पारंपरिक खोज: 0 मेल (क्योंकि शब्द "फ़नल" कभी फाइल नाम या टेक्स्ट में नहीं आया)।

मल्टीमॉडल एम्बेडिंग खोज: सही डेक को ~0.3 सेकंड में पाया, सही स्लाइड शीर्ष 2 परिणामों में मिली।

2. कोई नाजुक OCR निर्भरता नहीं

नियमित एआई खोज के साथ, छवियों के लिए डिफ़ॉल्ट "समाधान" है:

- OCR चलाएं।

- निकाले गए टेक्स्ट को किसी अन्य टेक्स्ट की तरह ट्रीट करें।

समस्याएँ:

- खराब स्क्रीनशॉट? OCR विफल।

- लेबल के साथ चार्ट? OCR आपको टुकड़े देता है।

- UI मॉकअप्स? आपको आंशिक आईडी और बेतुकी जानकारी मिलती है।

qwen3-शैली VL एम्बेडिंग के साथ, दृश्य संरचना (लेआउट, चार्ट आकृतियाँ, रंग पैटर्न) खोज योग्य बन जाती है:

- "डार्क थीम डैशबोर्ड जिसमें एक लाइन चार्ट और बैंगनी रंग का उच्चारण हो"

- "प्राइसिंग पेज जिसमें तीन कॉलम हैं और बीच का कॉलम हाइलाइटेड है"

ये प्रश्न अक्सर सही परिणाम लौटाते हैं। मेरे परीक्षणों में, OCR-केवल खोज को UI मॉकअप पर लगभग 55-60% अच्छे मिलान मिले: मल्टीमॉडल एम्बेडिंग ने इसे 85%+ तक पहुंचा दिया।

3. बेहतर पुनर्प्राप्ति → बेहतर जनरेटिव उत्तर

यदि आप RAG (रिट्रीवल ऑग्मेंटेड जेनरेशन) कर रहे हैं, तो आपकी पुनर्प्राप्ति की गुणवत्ता चुपचाप तय करती है कि आपके LLM उत्तर स्मार्ट होंगे या बेतुके।

केवल-पाठ RAG:

- लंबे दस्तावेज़ों और FAQs के लिए शानदार।

- आपके डैशबोर्ड्स, मिरो बोर्ड्स, फिग्मा डिज़ाइन, व्हाइटबोर्ड फ़ोटो को नहीं देख सकता।

RAG के लिए qwen3 vl एम्बेडिंग कार्यप्रवाह:

- एक प्रासंगिक छवि और उसके निकटतम पाठ पड़ोसियों को पुनः प्राप्त करें।

- दोनों को एक मल्टीमॉडल LLM में फीड करें।

- ऐसे उत्तर प्राप्त करें जो वास्तव में आरेख का संदर्भ देते हैं, न कि केवल अनुमान लगाते हैं।

जब मैंने एक सरल एनालिटिक्स Q&A बॉट में एक मल्टीमॉडल रिट्रीवर प्लग किया, तो "वास्तव में सही चार्ट में आधारित" दर 50 परीक्षण प्रश्नों में से ~70% से बढ़कर 93% हो गई। वही LLM, बस बेहतर पुनर्प्राप्ति।

वास्तविक उदाहरण जो आपने पहले ही उपयोग किए हैं (Google Photos, Pinterest)

भले ही आपने मल्टीमॉडल एम्बेडिंग शब्द कभी नहीं सुना हो, आपने इसे निश्चित रूप से इस्तेमाल किया है।

Google Photos: दोस्ताना मल्टीमॉडल लैब

इन शब्दों को Google Photos में टाइप करें:

- "बर्फ में कुत्ता"

- "2019 का जन्मदिन का केक"

- "रोडमैप के साथ व्हाइटबोर्ड"

यह आश्चर्यजनक रूप से सही फोटो दिखाएगा, भले ही:

- फ़ाइल के नाम IMG_9843.JPG हों।

- किसी ने कहीं भी "रोडमैप" शब्द नहीं लिखा हो।

अंदर की प्रक्रिया अवधारणात्मक रूप से qwen3 vl एम्बेडिंग सेटअप के समान है:

- छवियों को वेक्टर में एन्कोड किया जाता है।

- आपके टेक्स्ट क्वेरी को वेक्टर में एन्कोड किया जाता है।

- सिस्टम पास के वेक्टर वाली छवियों को ढूंढता है।

यह आपके दिमाग को नहीं पढ़ रहा है। यह केवल एक बहुत ही घना, बहुत ही स्मार्ट साझा गणितीय स्थान का उपयोग कर रहा है।

Pinterest विजुअल सर्च: इसे माहौल से खोजें

Pinterest का विजुअल सर्च ("समान पिन खोजें") मल्टीमॉडल एम्बेडिंग सर्च का एक और शानदार उदाहरण है।

आप एक तस्वीर में एक लैंप पर क्लिक करते हैं → अचानक आपको 40 अन्य लैंप विभिन्न कमरों, रंगों और शैलियों में दिखने लगते हैं। विस्तृत वर्कफ़्लो qwen3 VL से अलग है, लेकिन मुख्य विचार वही है: दृश्य सामग्री को एम्बेड करें और वेक्टर स्पेस में तुलना करें।

यही कारण है कि यह दिखा सकता है:

- समान लेआउट

- समान रंग

- समान अनुभूति, सिर्फ सटीक मेल नहीं

अब अंतर: आप इसे खुद बना सकते हैं

मॉडल जैसे qwen3 VL और इसके समकालीन उस एक बार भारी-भरकम संरचना वाले जादू को कुछ ऐसा बना रहे हैं जिसे आप अपने स्वतंत्र प्रोजेक्ट्स में जोड़ सकते हैं।

विशिष्ट रूप से, आपके अपने ऐप के लिए एक बुनियादी qwen3 vl एम्बेडिंग वर्कफ़्लो इस प्रकार दिखता है:

प्रवेश:

- छवियाँ / पीडीएफ / स्लाइड्स लें।

- उन्हें एक VL एम्बेडिंग मॉडल के माध्यम से चलाएँ।

- वेक्टरों को एक वेक्टर DB (जैसे, Qdrant, Weaviate, Pinecone, pgvector) में संग्रहीत करें।

खोज:

- उपयोगकर्ता के टेक्स्ट प्रश्न को लें।

- उसी मॉडल के साथ एम्बेड करें।

- निकटतम-पड़ोसी खोज करें।

प्रदर्शन:

- मूल छवि/स्लाइड + किसी भी संबंधित मेटाडेटा को लौटाएँ।

एक छोटे बेंचमार्क में मैंने एक ग्राहक के लिए सेट किया (लगभग 3,500 डिज़ाइन संपत्तियाँ और स्क्रीनशॉट्स), फ़ाइलनाम/टैग खोज से qwen-शैली के मल्टीमॉडल एम्बेडिंग खोज में जाने पर:

- उपयोगकर्ता परीक्षणों में "सही संपत्ति खोजने का समय" को ~40–60% तक कम कर दिया।

- "छोड़ दिया, संपत्ति को फिर से बनाया" क्षणों को साप्ताहिक से मूल रूप से शून्य तक गिरा दिया।

व्यक्तिगत एआई उपकरणों के लिए यह क्यों महत्वपूर्ण है

यहाँ है जहाँ यह स्वतंत्र निर्माताओं, लेखकों, और एकल SaaS बिल्डरों के लिए मज़ेदार हो जाता है: आपके पास पहले से ही बहुत सारा मल्टीमॉडल डेटा है। आप बस इसे सही से खोज नहीं पाए हैं।

आपका वास्तविक जीवन का गड़बड़ मल्टीमॉडल है

अपने कार्यक्षेत्र के बारे में सोचें:

- स्क्रीनशॉट्स फ़ोल्डर (यूआई विचार, प्रतियोगी, बग रिपोर्ट)

- स्लाइड डेक्स (ग्राहक प्रस्तुतियाँ, पाठ्यक्रम सामग्री)

- व्हाइटबोर्ड फ़ोटो (अजीब कोणों पर ली गई, खराब प्रकाश)

- पीडीएफ (रिपोर्ट, ईबुक, चालान)

एक पारंपरिक "AI नोट्स" टूल खुशी-खुशी टेक्स्ट बिट्स को खोज लेगा। बाकी लगभग डार्क मैटर है। एक qwen3 vl एम्बेडिंग शैली प्रणाली प्लग इन के साथ, अचानक आपका AI सहायक कर सकता है:

- वह एक स्लाइड खोजें जिसे आप धुंधले से याद करते हैं

- अपने क्लाइंट सारांश में सही चार्ट खींचें

- एक धुंधला टेक्स्ट वर्णन के आधार पर UI प्रेरणा खोजें

मेरी खुद की सेटअप में, मैंने एक छोटा FastAPI सेवा + वेक्टर DB + एक qwen-जैसे VL एम्बेडिंग मॉडल को जोड़ा। अब मैं कर सकता हूँ:

- टाइप करें: "वह स्लाइड जहाँ मैंने Q2 में चर्न बनाम सक्रियण की तुलना की थी एक लाल बार के साथ।"

- प्राप्त करें: सही स्लाइड + विभिन्न डेक्स से दो समान वेरिएंट।

यह अकेले ही मुझे "वह चीज़ कहाँ है" खोजों पर प्रतिदिन 10-15 मिनट बचा सकता है।

बेहतर व्यक्तिगत RAG प्रणाली

अधिकांश लोग जो RAG के साथ "दूसरा मस्तिष्क" बनाने की कोशिश कर रहे हैं, उसी दीवार से टकराते हैं:

मेरे नोट्स खोजने योग्य हैं, लेकिन दिलचस्प चीजें स्क्रीनशॉट्स और स्लाइड्स में रहती हैं।

वैयक्तिक ज्ञान के लिए एक qwen3 vl एम्बेडिंग वर्कफ़्लो इस प्रकार दिखता है:

सब कुछ सूचीबद्ध करें:

- टेक्स्ट फ़ाइलें → टेक्स्ट एम्बेडिंग्स।

- चित्र/स्लाइड्स/PDFs → VL एम्बेडिंग्स।

मोडैलिटी को लिंक करें:

- संदर्भ सहेजें ताकि प्रत्येक चित्र संबंधित टेक्स्ट हिस्सों (कैप्शन, मीटिंग नोट्स, दस्तावेज़ अंश) की ओर इशारा करे।

प्रश्न के समय:

- प्रश्न को टेक्स्ट और VL मॉडल्स (या यदि साझा किया गया तो केवल VL) के साथ एम्बेड करें।

- प्रासंगिक टेक्स्ट और चित्र दोनों प्राप्त करें।

- उत्तर देने के लिए सब कुछ एक LLM (आदर्श रूप से मल्टीमॉडल) को सौंपें।

आपको उत्तर मिलते हैं जैसे:

「यहाँ आपकी Q2 चर्न बनाम सक्रियण स्लाइड है, और चार्ट के आधार पर आपका सक्रियण दर अप्रैल और जून के बीच ~26% से ~34% तक सुधार हुआ है। इसके साथ लिखा नोट कहता है कि यह बदलाव नए ऑनबोर्डिंग प्रयोगों के कारण हुआ।」

इसके बजाय:

「मुझे कुछ भी प्रासंगिक नहीं मिला।」

अधिक ईमानदार समझौते

यह सब जादू नहीं है। कुछ वास्तविक सीमाएँ जो मैंने qwen-style VL एम्बेडिंग का परीक्षण करते समय अनुभव कीं:

- छवियों में छोटे टेक्स्ट अभी भी कठिन हो सकते हैं। छोटे अक्ष-अंकन या घने तालिकाएँ हमेशा सही नहीं बैठतीं।

- अत्यधिक अमूर्त प्रश्न जैसे "स्लाइड जहाँ मैं फंसा हुआ महसूस किया" स्पष्ट रूप से काम नहीं करेंगे।

- डोमेन-विशिष्ट आरेख (जैसे, विशेष इंजीनियरिंग नोटेशन) को फाइन-ट्यूनिंग या संकर विधियों की आवश्यकता हो सकती है।

लेकिन इन चेतावनियों के बावजूद, "केवल टेक्स्ट खोज योग्य है" से "टेक्स्ट + दृश्य एक ही अर्थ स्थान साझा करते हैं" की छलांग इतनी बड़ी है कि अब मैं किसी व्यक्तिगत एआई टूल का उपयोग करने के लिए अनिच्छुक हूँ जो कुछ प्रकार की मल्टीमॉडल एम्बेडिंग खोज की पेशकश नहीं करता।

इस तकनीक के लिए आगे क्या है

यदि हम ज़ूम आउट करते हैं, तो qwen3 vl एम्बेडिंग एक बड़े ट्रेंड का हिस्सा है: मॉडल एकल, सुसंगत स्थान में दुनिया को समझने में बेहतर होते जा रहे हैं (टेक्स्ट, छवियाँ, शायद ऑडियो/वीडियो के माध्यम से)।

यहाँ मैं देखता हूँ कि अगले 12-24 महीनों में यह कैसे आगे बढ़ रहा है, इस आधार पर कि चीजें पहले से ही कैसे बदल रही हैं।

1. अधिक उपकरणों में डिफ़ॉल्ट रूप से मल्टीमॉडल एम्बेडिंग्स शामिल हैं

अभी, आपको आमतौर पर सब कुछ स्वयं जोड़ना पड़ता है:

- एक VL मॉडल चुनें

- एक वेक्टर DB चुनें

- इनजेशन पाइपलाइन लिखें

मुझे उम्मीद है कि अधिक टूल्स अंतर्निहित मल्टीमॉडल एम्बेडिंग सर्च के साथ आएंगे:

- नोट ऐप्स जो आपके पेस्ट किए गए स्क्रीनशॉट्स को स्वचालित रूप से इंडेक्स करते हैं

- प्रोजेक्ट टूल्स जो मीटिंग फोटोज़ को व्हाइटबोर्ड सामग्री द्वारा खोजने योग्य बनाते हैं

- एसेट मैनेजर्स जो लेआउट, रंग, और UI संरचना को "समझते" हैं

जब यह होगा, लोग "वेक्टर DB" और "VL मॉडल" कहना बंद कर देंगे और बस कहेंगे, "हाँ, अब मैं अपने सामान को विवरण से खोज सकता हूँ।"

2. पुनःप्राप्ति और उत्पत्ति के बीच करीब संबंध

अभी, बहुत सारे RAG सेटअप अभी भी इस प्रकार हैं:

- एम्बेड

- पुनःप्राप्त

- एक LLM में डालें

मैं पहले से ही प्रोटोटाइप देख रहा हूँ (कुछ क्यूवेन-स्टाइल स्टैक्स सहित) जहाँ मॉडल:

- किस प्रकार के संदर्भ की आवश्यकता है, यह योजना बनाने के लिए मल्टीमॉडल एम्बेडिंग का उपयोग करता है

- यदि पहला बैच कमजोर है तो अधिक छवियाँ या पाठ मांगता है

- एक अलग प्रासंगिकता मॉडल का उपयोग करके परिणामों को पुनः क्रमित करता है

मेरे अपने प्रयोगों में, बेस मल्टीमॉडल एम्बेडिंग सर्च पर एक सरल पुनः-क्रमण चरण जोड़ने से "टॉप-1 वास्तव में वही है जो मैं चाहता था" में ~78% से लगभग 90% तक सुधार हुआ मेरे स्लाइड + स्क्रीनशॉट डेटासेट के लिए।

3. निर्माताओं के लिए व्यक्तिगत "दृश्य स्मृति"

विशेष रूप से स्वतंत्र निर्माताओं और विपणक के लिए, एक प्रभावी दिशा दृश्य स्मृति परत है:

- हर थंबनेल जो आपने परीक्षण किया

- हर विज्ञापन क्रिएटिव जो आपने चलाया

- हर स्लाइड जो आपने प्रस्तुत की

- हर लैंडिंग पेज वेरिएंट जो आपने शिप किया

सभी को एक बार qwen3 vl एम्बेडिंग वर्कफ़्लो के माध्यम से एम्बेड किया गया, ताकि आप बाद में पूछ सकें:

- "मुझे ऐसे विज्ञापन क्रिएटिव दिखाएं जो >5% CTR प्राप्त कर चुके हैं।"

- "उन पिछले थंबनेल को खोजें जहाँ मैंने गहरे रंग की पृष्ठभूमि और नारंगी टेक्स्ट का उपयोग किया था।"

- "किन लैंडिंग पेज लेआउट्स का उपयोग मैंने >8% रूपांतरण के लिए किया था?"

इसे विश्लेषण से जोड़ें, और आप सिर्फ़ दृश्य नहीं खोज रहे हैं, आप प्रदर्शनकारी दृश्य खोज रहे हैं।

4. जोखिम और ध्यान देने योग्य बातें

इसे यथार्थवादी बनाए रखने के लिए, मैं कुछ बातों का ध्यान रखता हूँ जब मैं मल्टीमॉडल एम्बेडिंग स्टैक्स का परीक्षण और अनुशंसा करता हूँ:

- गोपनीयता: स्क्रीनशॉट और स्लाइड्स को तीसरी पार्टी API को भेजना अक्सर क्लाइंट के काम के लिए असंभव होता है। सेल्फ-होस्टेबल VL मॉडल (qwen-स्टाइल शामिल) यहाँ महत्वपूर्ण होंगे।

- लागत: हजारों छवियों को एम्बेड करना मुफ्त नहीं है। एक बार की इंडेक्सिंग पास आमतौर पर ठीक है, लेकिन अगर आपके पास लाइव वीडियो फ्रेम या बार-बार अपडेट हैं, तो आपको टोकन और GPU बिल्स का ध्यान रखना होगा।

- मूल्यांकन: यह महसूस करना आसान है कि खोज अच्छी है। बेहतर है कि ट्रैक करें:

- लेबल वाले क्वेरी सेट पर टॉप-1 सटीकता

- आपके दैनिक कार्य में "एसेट तक का समय"

- कितनी बार आप अभी भी हार मान लेते हैं और कुछ नया बनाते हैं

मेरी सिफारिश यदि आप जिज्ञासु हैं

अगर आप पहले से ही AI उपकरणों के साथ प्रयोग कर रहे हैं, तो मेरी ईमानदार सिफारिश है: मल्टीमॉडल एम्बेडिंग के साथ एक छोटा सा प्रयोग करें।

विजुअल अराजकता के एक ढेर को लें — स्क्रीनशॉट फ़ोल्डर, स्लाइड आर्काइव, Pinterest बोर्ड निर्यात, जो भी हो। इसके ऊपर एक साधारण qwen3 vl एम्बेडिंग खोज सेट करें। एक वेक्टर DB का उपयोग करें, या परीक्षण के लिए एक ऑन-डिस्क इंडेक्स का उपयोग करें।

खुद को एक सप्ताह दें और इसे एक मनुष्य की तरह क्वेरी करें:

- "वह स्लाइड जहाँ…"

- "वह डैशबोर्ड जो दिखा रहा था…"

- "वह विज्ञापन जिसमें नीला बैकग्राउंड और आश्चर्यचकित चेहरा है…"

यदि आपका अनुभव मेरे जैसा है, तो आप एम्बेडिंग को एक बोरिंग इन्फ्रा शब्द के रूप में देखना बंद कर देंगे और उन्हें 'मेरी चीजें एक ब्लैक होल हैं' और 'मेरी चीजें मेरी स्मृति का विस्तार हैं' के बीच का अंतर समझेंगे।

और एक बार ऐसा होने के बाद, वापस जाना बहुत कठिन हो जाता है।

मॉडल के बारे में: Qwen3-VL-Embedding को 8 जनवरी, 2026 को अलीबाबा की Qwen टीम द्वारा जारी किया गया था। यह 30 से अधिक भाषाओं का समर्थन करता है और MMEB-v2 (79.2 कुल स्कोर) और MMTEB (74.9 रीरेंकर के साथ) जैसे मल्टीमॉडल बेंचमार्क पर अत्याधुनिक परिणाम प्राप्त करता है। मॉडल ओपन-सोर्स है और Hugging Face, GitHub, और ModelScope पर उपलब्ध है।