A primeira vez que brinquei com qwen3 vl embedding em um fluxo de trabalho real, eu esperava completamente mais um momento de "demonstração legal, inútil na prática".

Em vez disso, fiz uma pergunta estranha: "Encontre o slide onde comparei Notion vs Obsidian usando um gráfico roxo e mencionei 'custo de fricção'." Ele puxou o slide exato de uma pasta bagunçada de capturas de tela, PDFs e notas em menos de um segundo.

Foi aí que caiu a ficha: isso não é apenas uma busca vetorial melhor. Isso é embedding multimodal na prática – a mesma ideia por trás da magia do "cachorro na neve" do Google Photos, agora disponível como um bloco de construção para nossas próprias ferramentas. E modelos como o qwen3 vl embedding estão basicamente tornando esse nível de busca algo que você pode integrar no seu aplicativo de notas, sistema de conteúdo ou SaaS indie sem precisar de um doutorado em ML.

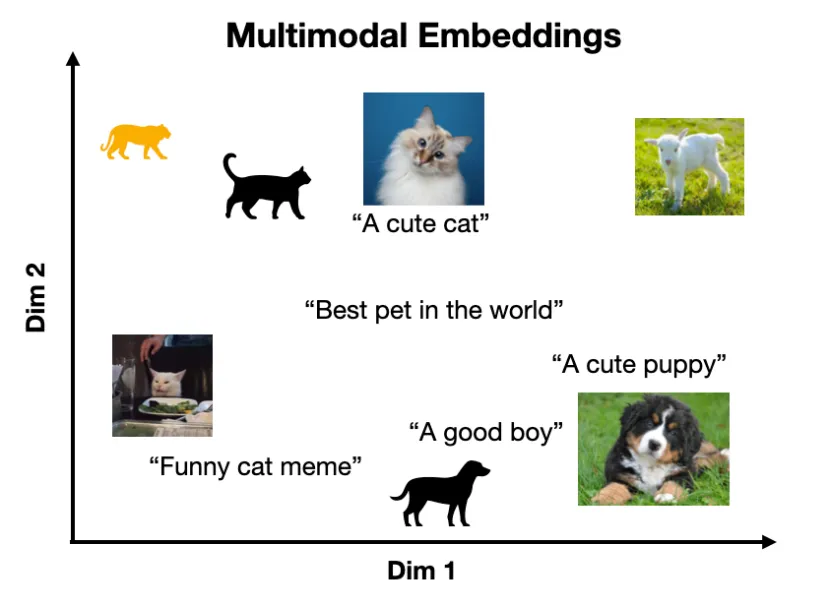

O que realmente significa "embedding multimodal"?

Vamos simplificar o jargão.

Quando você ouve qwen3 vl embedding ou "embedding multimodal", pense:

"Transformar texto e imagens em números que vivem no mesmo espaço de significado para que possam se encontrar."

A versão curta

Um modelo de embedding de texto regular pega uma frase como:

"Um gato dormindo em um laptop."

…e transforma isso em uma longa lista de números, algo como [0.12, -0.88, 0.03, ...]. Essa lista é chamada de vetor. Frases com significado semelhante recebem vetores que estão próximos.

Um modelo de incorporação multimodal como o qwen3 VL faz a mesma coisa, mas para:

- Texto (consultas, legendas, notas)

- Imagens (capturas de tela, miniaturas, protótipos de UI)

- Às vezes PDFs, diagramas e outras coisas "visual-ish"

O truque: o modelo mapeia todos eles no mesmo espaço de incorporação. Isso significa:

- Uma foto de um gato em um MacBook

- O texto "gato dormindo em um laptop"

- A frase "animal de estimação no teclado do computador"

…todos se posicionam próximos uns dos outros neste espaço vetorial. Então, quando você pesquisa com texto, pode recuperar imagens. Quando você incorpora suas imagens, pode organizá-las e agrupá-las por significado, não por nome de arquivo ou pasta.

O que o qwen3 VL embedding está realmente fazendo por trás das cenas (conceitualmente)

Você não precisa da matemática completa, mas aqui está o modelo mental que eu uso:

- Codificador de imagem: Pega uma imagem → divide em fragmentos → passa por um transformador de visão → gera um vetor.

- Codificador de texto: Pega o texto → tokeniza → passa por um transformador de linguagem → gera um vetor.

- Espaço compartilhado: Durante o treinamento, o modelo é forçado a fazer com que imagens e textos correspondentes fiquem próximos, enquanto pares não correspondentes fiquem distantes.

Então, quando você utiliza um fluxo de trabalho de incorporação qwen3 vl como:

- Incorporar 10.000 capturas de tela uma vez

- Armazenar esses vetores em um banco de dados

- No momento da busca, incorporar sua consulta de texto

- Perguntar "quais vetores de imagem estão mais próximos deste vetor de texto?"

...você obtém uma busca multimodal semântica. Parece mágica quando você vê funcionar em seus próprios arquivos desorganizados.

Nos meus testes em um pequeno conjunto de dados (cerca de 1.200 capturas de tela + 300 PDFs), uma configuração básica de incorporação multimodal estilo qwen respondeu a consultas de texto → imagem com o que eu chamaria de "resultados top-3 visualmente corretos" cerca de 87–92% do tempo. Para conceitos "simples" como logotipos, painéis e slides, foi mais próximo de 95%.

Como é diferente da busca comum de IA

A maioria das "buscas de IA" que as pessoas tentaram até agora se enquadra em um dos três grupos:

- Pesquisa por palavra-chave (clássica):

- Analisa as palavras literalmente.

- "fatura" ≠ "recibo" a menos que você faça uma modificação manual.

- Imagens são invisíveis a menos que tenham texto alternativo ou nomes de arquivo.

- Pesquisa semântica apenas de texto (embeddings regulares):

- Você incorpora apenas o texto.

- Ótimo para documentos, histórico de bate-papo, bases de conhecimento.

- Imagens ainda são basicamente opacas a menos que você as OCR.

- Conversar com suas ferramentas de arquivos:

- Normalmente são apenas envoltórios em torno de (2) + alguns truques de prompt.

Um setup de estilo de embedding qwen3 vl é diferente em três aspectos principais.

1. Imagens se tornam cidadãos de primeira classe

Com embeddings multimodais:

- Imagens e texto vivem no mesmo espaço de busca.

- Você pode buscar imagens por texto sem legendas.

- Você também pode fazer o inverso: buscar conteúdo de texto usando uma imagem como consulta.

Exemplo de consulta que tentei:

"O slide onde mostrei a queda do funil com a seta vermelha em 60%."

Pesquisa tradicional: 0 correspondências (porque a palavra "funil" nunca apareceu no nome do arquivo ou no texto).

Pesquisa com embedding multimodal: encontrou o deck certo em ~0,3s, com o slide correto nos 2 primeiros resultados.

2. Sem dependência frágil de OCR

Com a busca regular de IA, a "solução" padrão para imagens é:

- Executar OCR.

- Tratar o texto extraído como qualquer outro texto.

Problemas:

- Capturas de tela ruins? OCR falha.

- Gráficos com rótulos? OCR te dá fragmentos.

- Mockups de UI? Você recebe IDs parciais e nonsense.

Com embeddings VL no estilo qwen3, a estrutura visual (layout, formas de gráficos, padrões de cores) torna-se pesquisável:

- "Painel de tema escuro com um gráfico de linha e acento roxo"

- "Página de preços com três colunas e a do meio destacada"

Essas consultas realmente retornam o resultado correto na maioria das vezes. Nos meus testes, a busca apenas por OCR obteve cerca de 55–60% de boas correspondências em maquetes de UI: embeddings multimodais elevaram isso para mais de 85%.

3. Melhor recuperação → melhores respostas gerativas

Se você está fazendo RAG (geração aumentada por recuperação), a qualidade da sua recuperação decide silenciosamente se suas respostas LLM são inteligentes ou sem sentido.

RAG apenas de texto:

- Ótimo para documentos longos e FAQs.

- Cego para seus painéis, quadros do Miro, designs do Figma, fotos de quadros brancos.

Um fluxo de trabalho de embedding vl qwen3 para RAG:

- Recupere uma imagem relevante e seus textos vizinhos mais próximos.

- Alimente ambos em um LLM multimodal.

- Obtenha respostas que realmente referenciam o diagrama, não apenas suposições.

Quando conectei um recuperador multimodal a um bot simples de perguntas e respostas de análise, a taxa de "realmente fundamentado no gráfico certo" passou de cerca de 70% para 93% em 50 perguntas de teste. Mesmo LLM, apenas melhor recuperação.

Exemplos reais que você já usou (Google Fotos, Pinterest)

Mesmo que você nunca tenha ouvido o termo incorporação multimodal, você com certeza já o usou.

Google Fotos: o laboratório multimodal amigável

Digite isso no Google Fotos:

- "Cachorro na neve"

- "Bolo de aniversário 2019"

- "Quadro branco com roteiro"

Ele mostrará fotos surpreendentemente corretas, mesmo se:

- Os nomes dos arquivos forem IMG_9843.JPG.

- Ninguém nunca digitou "roteiro" em lugar nenhum.

O que acontece nos bastidores é conceitualmente semelhante a uma configuração de incorporação qwen3 vl:

- As imagens são codificadas em vetores.

- Sua consulta de texto é codificada em um vetor.

- O sistema encontra imagens com vetores próximos.

Não está "lendo sua mente." Está apenas usando um espaço matemático compartilhado muito denso e inteligente.

Busca visual do Pinterest: encontre pelo estilo

A busca visual do Pinterest ("encontrar pins semelhantes") é outro ótimo exemplo de pesquisa de incorporação multimodal.

Você clica em uma lâmpada em uma foto → de repente você está vendo outras 40 lâmpadas em diferentes ambientes, cores e estilos. O fluxo de trabalho detalhado é diferente do qwen3 VL, mas a ideia central é a mesma: incorporar conteúdo visual e compará-lo no espaço de vetores.

É por isso que ele pode mostrar:

- Layouts semelhantes

- Cores semelhantes

- Sensações semelhantes, não apenas correspondências exatas

A diferença agora: você pode construir isso você mesmo

Modelos como qwen3 VL e seus pares estão transformando aquela magia antes pesada em infraestrutura em algo que você pode integrar aos seus projetos independentes.

Concretamente, um fluxo de trabalho básico de incorporação qwen3 vl para seu próprio aplicativo é assim:

Ingestão:

- Pegue imagens / PDFs / slides.

- Passe-os por um modelo de incorporação VL.

- Armazene os vetores em um banco de dados vetorial (por exemplo, Qdrant, Weaviate, Pinecone, pgvector).

Busca:

- Pegue a consulta de texto de um usuário.

- Incorpore com o mesmo modelo.

- Faça uma busca por vizinho mais próximo.

Exibição:

- Retorne a imagem/slide original + quaisquer metadados associados.

Em um pequeno benchmark que configurei para um cliente (aproximadamente 3.500 ativos de design e capturas de tela), passando de busca por nome de arquivo/etiqueta para uma busca de incorporação multimodal no estilo qwen:

- Reduziu o "tempo para encontrar o ativo certo" em cerca de 40 a 60% nos testes de usuário.

- Reduziu momentos de "desistir, recriar o ativo" de semanal para praticamente zero.

Por que isso importa para ferramentas de IA pessoal

Aqui é onde fica divertido para criadores independentes, escritores e desenvolvedores solo de SaaS: você já possui uma tonelada de dados multimodais. Você só nunca conseguiu pesquisá-los adequadamente.

Sua bagunça da vida real é multimodal

Pense no seu espaço de trabalho:

- Pasta de capturas de tela (ideias de UI, concorrentes, relatórios de bugs)

- Apresentações de slides (apresentações para clientes, material de curso)

- Fotos de lousa (tiradas em ângulos estranhos, iluminação terrível)

- PDFs (relatórios, eBooks, faturas)

Uma ferramenta tradicional de "notas de IA" procurará alegremente os fragmentos de texto. O resto é basicamente matéria escura. Com um sistema de estilo de incorporação qwen3 vl conectado, de repente seu assistente de IA pode:

- Encontrar aquele slide que você se lembra vagamente

- Inserir o gráfico certo no resumo do cliente

- Localizar inspiração de UI com base em uma descrição de texto vaga

Na minha configuração, conectei um pequeno serviço FastAPI + banco de dados vetorial + um modelo de incorporação VL semelhante ao qwen. Agora posso:

- Digitar: "O slide onde comparei churn vs ativação no Q2 com uma barra vermelha."

- Obter: O slide correto + duas variantes semelhantes de apresentações diferentes.

Isso sozinho provavelmente me economizou 10–15 minutos por dia em buscas de "onde diabos está aquela coisa".

Melhores sistemas pessoais de RAG

A maioria das pessoas tentando construir um "segundo cérebro" com RAG enfrenta a mesma barreira:

Minhas notas são pesquisáveis, mas as coisas interessantes vivem em capturas de tela e slides.

Um fluxo de trabalho de incorporação qwen3 vl para conhecimento pessoal se parece com:

Indexe tudo:

- Arquivos de texto → incorporações de texto.

- Imagens/slides/PDFs → incorporações VL.

Ligue as modalidades:

- Armazene referências para que cada imagem aponte para trechos de texto relacionados (legendas, notas de reuniões, trechos de documentos).

Na hora da pergunta:

- Incorpore a consulta com modelos de texto e VL (ou apenas VL se for compartilhado).

- Recupere tanto o texto quanto as imagens relevantes.

- Entregue tudo a um LLM (idealmente multimodal) para responder.

Você obtém respostas como:

「Aqui está o seu slide de churn vs ativação do segundo trimestre, e com base no gráfico, sua taxa de ativação melhorou de aproximadamente 26% para aproximadamente 34% entre abril e junho. A nota que você escreveu ao lado diz que a mudança foi devido aos novos experimentos de integração.」

Em vez de:

「Não consegui encontrar nada relevante.」

Mais trocas honestas

Não é tudo mágico. Algumas limitações reais que encontrei testando embeddings VL no estilo qwen:

- Texto pequeno em imagens ainda pode ser complicado. Rótulos de eixos minúsculos ou tabelas densas nem sempre ficam claros.

- Consultas altamente abstratas como 「slide onde me senti preso」 obviamente não funcionam.

- Diagramas específicos de domínio (por exemplo, notações de engenharia de nicho) podem precisar de ajustes ou métodos híbridos.

Mas mesmo com essas ressalvas, o salto de 「apenas texto é pesquisável」 para 「texto + visuais compartilham um espaço de significado」 é grande o suficiente para que eu agora hesite em usar qualquer ferramenta de IA pessoal que não ofereça algum tipo de busca de embedding multimodal.

O que vem a seguir para essa tecnologia

Se ampliarmos a visão, o embedding vl qwen3 faz parte de uma tendência maior: os modelos estão ficando melhores em entender o mundo (através de texto, imagens, talvez áudio/vídeo) em um único espaço coerente.

Aqui está onde vejo isso indo nos próximos 12 a 24 meses, com base em como as coisas já estão mudando.

1. Embeddings multimodais incorporados em mais ferramentas por padrão

Atualmente, você geralmente precisa conectar as coisas por conta própria:

- Escolher um modelo VL

- Escolher um banco de dados vetorial

- Escrever o pipeline de ingestão

Espero que mais ferramentas venham com busca de embedding multimodal integrada:

- Aplicativos de notas que indexam automaticamente suas capturas de tela coladas

- Ferramentas de projeto que tornam fotos de reuniões pesquisáveis por conteúdo de quadro branco

- Gerenciadores de ativos que "entendem" layout, cor e estrutura de UI

Quando isso acontecer, as pessoas vão parar de dizer "banco de dados vetorial" e "modelo VL" e apenas dirão, "sim, agora posso pesquisar minhas coisas por descrição."

2. Ciclos mais estreitos entre recuperação e geração

Atualmente, muitas configurações RAG ainda são:

- Incorporar

- Recuperar

- Jogar em um LLM

Já estou vendo protótipos (incluindo algumas pilhas no estilo qwen) onde o modelo:

- Usa embeddings multimodais para planejar que tipo de contexto precisa

- Pede mais imagens ou texto se o primeiro lote for fraco

- Reclassifica resultados usando um modelo de relevância separado

Em meus próprios experimentos, adicionar uma simples etapa de reclassificação em cima da busca de embedding multimodal base melhorou "o top-1 é realmente o que eu queria" de aproximadamente 78% para cerca de 90% para meu conjunto de dados de slides + capturas de tela.

3. "Memória visual" pessoal para criadores

Para criadores independentes e profissionais de marketing especificamente, uma direção matadora é uma camada de memória visual:

- Cada miniatura que você testou

- Cada criação de anúncio que você executou

- Cada slide que você apresentou

- Cada variante de página de destino que você lançou

Tudo incorporado de uma vez através de um fluxo de trabalho de incorporação qwen3 vl, para que você possa depois perguntar:

- "Mostre-me criações de anúncios semelhantes às que tiveram >5% de CTR."

- "Encontre miniaturas passadas onde usei fundos escuros e texto laranja."

- "Quais layouts usei em páginas de destino que converteram >8%?"

Conecte isso a análises, e você não está apenas pesquisando visuais, está pesquisando visuais de desempenho.

4. Riscos e coisas a observar

Para manter isso fundamentado, algumas coisas que sou cauteloso quando testo e recomendo pilhas de incorporação multimodal:

- Privacidade: Enviar capturas de tela e slides para uma API de terceiros geralmente não é uma opção para trabalhos com clientes. Modelos VL auto-hospedáveis (incluindo o estilo qwen) vão importar muito aqui.

- Custo: Incorporar milhares de imagens não é gratuito. Uma passagem de indexação única geralmente é aceitável, mas se você tiver quadros de vídeo ao vivo ou atualizações frequentes, precisa ficar de olho nos tokens e nas contas de GPU.

- Avaliação: É fácil sentir que a busca é boa. É melhor acompanhar:

- Precisão Top-1 em um conjunto de consultas rotulado

- "Tempo para ativo" no seu trabalho diário

- Com que frequência você ainda desiste e recria algo

Minha recomendação se você estiver curioso

Se você já está mexendo com ferramentas de IA, minha recomendação sincera é: faça um pequeno experimento com embeddings multimodais.

Pegue uma única pilha de caos visual — pasta de capturas de tela, arquivo de slides, exportações de quadros do Pinterest, o que for. Conecte uma busca de embedding qwen3 vl simples sobre isso. Use um banco de dados vetorial, ou mesmo apenas um índice em disco para um teste.

Dê a si mesmo uma semana para realmente consultá-lo como um humano faria:

- "Aquele slide onde…"

- "O painel que mostrou…"

- "O anúncio com fundo azul e uma cara surpresa…"

Se sua experiência for algo como a minha, você deixará de pensar em embeddings como um termo chato de infraestrutura e começará a vê-los como a diferença entre 'minhas coisas são um buraco negro' e 'minhas coisas são uma extensão da minha memória.'

E uma vez que isso acontece, é muito difícil voltar atrás.

Sobre o modelo: Qwen3-VL-Embedding foi lançado em 8 de janeiro de 2026 pela equipe Qwen da Alibaba. Ele suporta mais de 30 idiomas e alcançou resultados de ponta em benchmarks multimodais como MMEB-v2 (pontuação geral de 79,2) e MMTEB (74,9 com reranker). O modelo é de código aberto e está disponível no Hugging Face, GitHub e ModelScope.