Além da Memória: Rumo a uma Continuidade do Eu

A identidade humana e a continuidade pessoal não são armazenadas em um banco de dados; elas emergem da narrativa, contexto e mudanças ao longo do tempo. Da mesma forma, o Cérebro do Macaron evita qualquer modelo simplista de 「carteira de identidade」 do usuário. Não há um único objeto estático no sistema rotulado como 「perfil de personalidade do Usuário X」 ou uma lista canônica de fatos sobre o usuário que deva ser verdadeira para sempre. Em vez disso, a continuidade é tratada como uma propriedade emergente de muitas pequenas interações, memórias e adaptações entrelaçadas. Essa abordagem evita deliberadamente dois problemas: fragilidade e estagnação. Uma identidade frágil em termos de IA pode ocorrer se o sistema se apegar a fatos isolados (「Usuário mencionou que gostava de xadrez em 2022」) e tratá-los como permanentemente definidores. Então, se algum fato estiver errado ou mudar (usuário parar de gostar de xadrez), o modelo do sistema se quebra ou fica inconsistente. Uma identidade estagnada surge se a IA assumir permanência de objeto para todos os traços do usuário – o que significa que nunca esquece ou atualiza informações, levando a um modelo de usuário ossificado que não evolui. O Cérebro do Macaron evita ambos ao não se comprometer totalmente com nenhum fato como eterno, e ao permitir o que poderíamos chamar de esquecimento gracioso e reformulação.

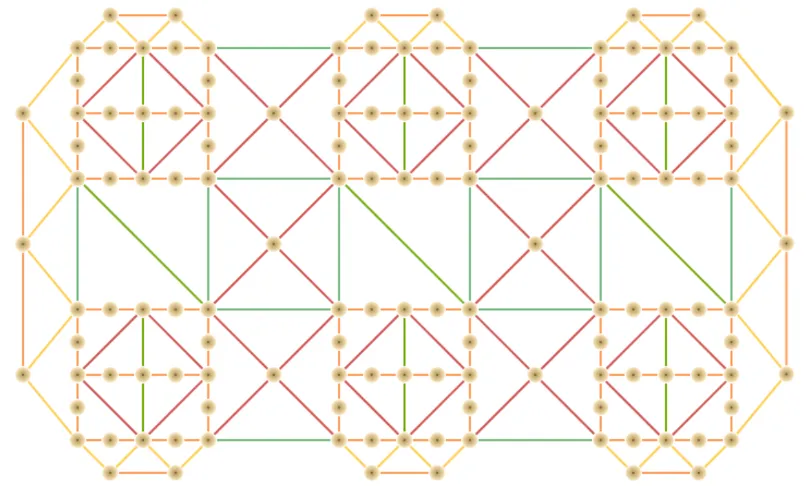

Em vez de permanência de objeto, Macaron depende da permanência de contexto: a ideia de que cada contexto ou fio de conversa mantém a coerência localmente, e a continuidade ao longo do tempo é alcançada ao entrelaçar esses fios de contexto quando relevante. Não há um único "objeto" representando o usuário que persiste inalterado; há múltiplas representações vinculadas ao contexto que podem ser invocadas e atualizadas conforme necessário. Isso é análogo a como uma pessoa pode se apresentar de maneira diferente em diferentes círculos sociais, mas mantém uma continuidade subjacente. O Cérebro do Macaron mantém a identidade como algo distribuído e fluido. A identidade não está em um nó de memória específico, mas nas conexões e padrões que persistem ao longo das memórias. Em essência, a continuidade do eu é uma narrativa emergente, não uma entrada em um banco de dados.

Para um exemplo concreto, considere como o Macaron lembra a preferência de um usuário. Em vez de armazenar 「Cor favorita do usuário = azul」 em um perfil, o Cérebro do Macaron irá relembrar isso no contexto de conversas relevantes (se o usuário falou sobre cores em uma conversa de design na semana passada, essa memória é recuperável em um contexto de design). Se no próximo ano o usuário expressar uma nova preferência (agora gosta de verde), o Cérebro não precisa realizar uma atualização destrutiva de um campo canônico. A nova informação é simplesmente outro ponto de dados na linha do tempo, e quando o contexto de design surgir novamente, a preferência mais recente naturalmente terá mais peso devido à atualidade e relevância, enquanto a antiga se torna menos significativa. Assim, a continuidade é mantida priorizando contextualmente as informações mais recentes e relevantes, não assumindo que o fato antigo era 「o verdadeiro eu permanente」. O fato anterior não é perdido – é apenas despriorizado (mais sobre isso em decadência referencial). Isso proporciona uma identidade não frágil: nenhum dado desatualizado único pode quebrar o entendimento do usuário pelo Macaron, porque o entendimento nunca foi baseado em fatos estáticos, mas em padrões e contexto.

Fronteiras Distribuídas: Muitos Eus, Um Só Eu

Uma escolha arquitetônica notável no Brain do Macaron é o uso de limites distribuídos para conhecimento e memória. Em vez de agregar tudo o que a IA sabe sobre o usuário em um único modelo ou repositório central, o Macaron segrega o conhecimento por contexto, origem ou limites temáticos. Por exemplo, interações relacionadas à vida profissional do usuário podem ser mantidas em um 「espaço vetorial」 ou subsistema, enquanto conversas pessoais residem em outro, e assim por diante. Estes não são silos no sentido de serem incapazes de se comunicar – na verdade, são zonas de fronteira que podem se conectar quando necessário, mas não se fundem automaticamente. Este design espelha a ideia psicológica de que as pessoas têm múltiplas facetas ou 「eus」 (eu do trabalho, eu da família, etc.), que juntas formam a pessoa inteira, mas são ativadas contextualmente.

Ao distribuir limites de memória, o Macaron garante que cada faceta da identidade do usuário seja internamente coerente e não contaminada por informações não relacionadas. Por exemplo, se o usuário tiver um contexto de 「hobby」 sobre preferências musicais e um contexto separado de 「trabalho」 sobre gerenciamento de projetos, o sistema não aplicará acidentalmente preferências musicais casuais ao responder uma consulta formal relacionada ao trabalho, a menos que seja explicitamente relevante. Isso evita respostas errôneas ou constrangedoras que misturam contextos de forma inadequada. Também melhora a privacidade: informações sensíveis de um contexto não estão indiscriminadamente disponíveis para outros. Tecnicamente, o Macaron consegue isso criando gráficos de conhecimento ou índices vetoriais separados por domínio ou sessão, semelhante ao que arquiteturas de IA pessoal como o Memno fazem – 「cada usuário existe em seu próprio universo」, e dentro disso, há uma segmentação adicional. Os dados de cada usuário são isolados dos outros (esse é um limite no nível do usuário), mas dentro de um usuário, há mais delimitações com base no contexto ou fonte de dados.

No entanto, o ponto crucial é que a continuidade do eu ainda surge através dessas fronteiras. O Cérebro do Macaron pode estabelecer conexões entre memórias específicas de contexto quando apropriado. Chamamos isso de federação por relevância: se a conversa do usuário hoje em um contexto social abordar um projeto que discutiram anteriormente em um contexto de trabalho, o Macaron pode buscar insights relevantes desse contexto de trabalho – mas faz isso com cuidado e consciência da fronteira (como citar esse conhecimento como vindo de 「aquela discussão do projeto」). A natureza distribuída significa que não há um único 「perfil mestre」 para se referir; o AI deve navegar pela teia de contextos para montar informações relevantes de identidade em tempo real. Isso é mais complexo computacionalmente do que uma busca em banco de dados unificado, mas resulta em uma continuidade mais rica e sensível ao contexto.

Importante, os limites distribuídos também servem para nossa postura de privacidade e anti-perfilagem. Ao não centralizar o modelo do usuário, o Macaron evita inerentemente a construção de um perfil comportamental unificado que poderia ser explorado ou mal utilizado (o que é benéfico para a autonomia e privacidade do usuário). Cada contexto pode até mesmo ser efêmero se desejado – por exemplo, um contexto sensível pode ser configurado para autoexcluir-se após o uso, deixando apenas um resumo de alto nível na memória de longo prazo. No entanto, mesmo quando partes individuais desaparecem, a tapeçaria da narrativa do usuário permanece intacta através dos fios sobrepostos dos contextos restantes. Esta é a essência de uma identidade não frágil: ela é armazenada de forma redundante e distribuída. Nenhum único contexto define o usuário, e perder qualquer contexto não apaga o eu.

Decaimento Referencial: Esquecimento como Recurso

Para que o Cérebro do Macaron mantenha a consistência narrativa sem ossificação, ele utiliza um conceito que chamamos de decadência referencial. Em termos simples, a decadência referencial é uma estratégia de desvanecer gradualmente a influência de referências ou memórias específicas ao longo do tempo, a menos que sejam reforçadas. Em vez de uma exclusão estrita, as informações "perdem importância" com o tempo. Isso se inspira na memória humana: não lembramos de cada conversa literalmente; os detalhes desaparecem, mas os padrões importantes permanecem. No Macaron, cada item de memória tem uma espécie de idade ou peso de uso. Cada vez que é usado ou citado em uma conversa, ele é renovado (reforçado). Itens não utilizados veem seu peso lentamente atenuar.

O efeito do decaimento referencial é que o Cérebro do Macaron foca no que é relevante e atual, alinhando-se com a narrativa em evolução do usuário. Se um usuário falou pela última vez sobre o tópico X há dois anos e nunca mais o mencionou, o sistema tratará esse tópico como periférico, a menos que o usuário o mencione novamente. Isso evita o problema comum dos sistemas de IA que lembram demais, fazendo com que eles tragam à tona detalhes irrelevantes do passado e confundam o fluxo da conversa. Como um pesquisador de memória de IA observou, uma IA com memória perfeita e indiscriminada pode se tornar como "um amigo irritante que continua trazendo à tona tópicos sem importância de conversas passadas, incapaz de entender que interesses e prioridades mudam". O decaimento referencial previne esse comportamento ao esquecer funcionalmente as trivialidades do passado em favor do contexto presente.

A implementação técnica do decaimento referencial no Cérebro do Macaron pode envolver a atribuição de uma função de decaimento a embeddings de vetor ou arestas de grafos de conhecimento. Ao longo do tempo (ou após muitas novas interações), a pontuação de similaridade ou o potencial de ativação de nós de memória mais antigos diminui. Fundamentalmente, não apagamos memórias de forma direta (a menos que solicitado pelo usuário); em vez disso, conforme sugere uma estrutura, o sistema mantém um registro histórico completo, mas simplesmente desprioriza o que está desatualizado. Tudo ainda está lá em armazenamento profundo (muito parecido com nossos cérebros, que provavelmente codificam mais do que conseguimos recordar), mas o que é prontamente recuperável tende para o recente e o frequentemente mencionado. Este design serve a dois propósitos: mantém a coerência assegurando que as contribuições da IA reflitam o estado atual da vida e das preferências do usuário, e também espelha um aspecto importante da agência pessoal – a capacidade de seguir em frente, de mudar, de fazer com que informações antigas se tornem menos definidoras.

Do ponto de vista de conformidade (relacionando com a Privacidade), o decaimento referencial também se alinha com a minimização de dados. O Macaron não está empurrando agressivamente dados pessoais antigos em todas as interações; está usando-os apenas quando são contextualmente relevantes. Isso reduz o risco de uso inadequado de dados antigos. Pode-se dizer que o Cérebro do Macaron implementa uma forma de 「política de retenção」 sobre os dados pessoais aprendidos ao esquecer gradualmente na prática o que não é mais necessário – embora sem perder a memória da memória (podemos sempre mergulhar nos arquivos se necessário, assim como uma pessoa pode, sob profunda reflexão, recordar algo há muito tempo desfocado).

O benefício emergente é que a identidade se torna resiliente. Se o usuário muda drasticamente (novo emprego, novo hobby, mudança de crenças), o decaimento referencial permite que a IA se adapte suavemente. Não é necessário uma substituição rígida de um perfil central; a nova informação naturalmente eclipsa a antiga. No entanto, se o contexto antigo se tornar relevante (talvez uma conversa nostálgica anos depois), o Macaron ainda pode recuperá-lo – assim, a continuidade é preservada em segundo plano, mas não imposta em primeiro plano. Essa dinâmica de lembrar e esquecer é primordial para a coerência intertemporal: garante que o entendimento da IA hoje harmonize com a realidade de hoje, mesmo enquanto mantém silenciosamente uma narrativa completa em segundo plano.

Trançado Temporal: Tecendo o Tempo na Memória

Se o decaimento referencial gerencia o esquecimento, a trançagem temporal gerencia a lembrança ao longo do tempo. Usamos o termo 「trançagem」 para evocar como o Cérebro do Macaron entrelaça múltiplas linhas do tempo de contexto para criar uma compreensão coesa. A experiência humana é inerentemente temporal – nossa identidade é uma história que contamos a nós mesmos, ligando passado, presente e futuro. O Cérebro do Macaron tenta simular isso ao entrelaçar memórias de diferentes tempos quando necessário, criando efetivamente uma narrativa trançada.

Imagine que o usuário tenha tido conversas recorrentes sobre escrever um romance: uma há seis meses, outra há duas semanas e uma hoje. Cada conversa é um fio. Entrelaçamento temporal significa que o Macaron pode extrair conhecimento de todos esses fios e apresentar uma continuidade sintetizada: 「Você mencionou no passado [6 meses atrás] que prefere escrever de manhã, e recentemente [2 semanas atrás] estava explorando temas de ficção científica. Hoje você está perguntando sobre agendar tempo para escrever – talvez combine essas percepções: reserve as manhãs para escrever capítulos de ficção científica.」 A IA não tinha um único arquivo explicitamente chamado 「projeto de romance」 (embora pudesse etiquetar tópicos); em vez disso, entrelaçou as peças temporalmente separadas em um único fio de discurso. Isso é possibilitado pelo anexo de metadados temporais às memórias e pela ligação intencional de itens relacionados ao longo do tempo. A arquitetura de memória do Macaron usa índices conscientes do tempo: as memórias não são apenas rotuladas por tópico, mas por quando ocorreram. Isso permite uma recuperação que pode abranger diferentes períodos, mas dentro do mesmo contexto temático.

Pode-se comparar a tecelagem temporal a manter várias janelas de contexto abertas e depois entrelaçá-las. O 「eu atual」 do usuário é composto por ecos de seus eus passados, e as respostas do Macaron refletem essa sobreposição. A arquitetura pode empregar sumarização ou modelagem narrativa que incorpora explicitamente o tempo (「anteriormente, na sua história…」). Importante, isso é feito sem assumir que o passado é uma verdade estática – em vez disso, o passado é tratado como contexto de fundo para informar o presente. O resultado entrelaçado é uma continuidade mais forte: o usuário sente que a IA lembra da jornada que ele percorreu, não apenas de pontos isolados. No entanto, devido à decadência referencial, a trama enfatizará os fios mais espessos e frescos (menções recentes) sobre os desbotados.

Esta abordagem está alinhada com pesquisas que sugerem que a IA precisa de consciência temporal para manter interações coerentes a longo prazo. Por exemplo, uma proposta é dar aos sistemas de memória da IA uma noção de validade temporal e tratar os fatos como carimbados no tempo, para que a IA possa discernir entre "não é mais verdade" e "ainda é atual". O Cérebro do Macaron adota isso ao, por exemplo, marcar uma informação como "Usuário mora em Paris [2019-2023]" e, se em 2024 o usuário mencionar uma mudança para Londres, a informação sobre Paris é contextualmente marcada como desatualizada. Assim, em uma conversa, o Macaron não confundirá as duas – mas, se o usuário se lembrar de Paris, essas memórias estarão disponíveis. Na prática, o Macaron pode trançar linhas do tempo: o eu presente (Londres) e um eu passado (Paris) coexistem na narrativa, mas não se confundem. A continuidade do usuário é representada como uma tapeçaria de linha do tempo, não como uma única imagem.

O trançado temporal também significa que a noção de verdade do Macaron é temporal e contextual. Não há fato canônico eterno como um banco de dados poderia armazenar; há "o que era verdade então" e "o que é verdade agora" e potencialmente "o que poderia ser verdade depois" (se estiver planejando ou simulando cenários futuros). Este último sugere o próximo conceito: ancoragem contrafactual.

Ancoragem Contrafactual: Estabilidade Sem Síntese

Uma das técnicas mais especulativas, mas intrigantes, no cérebro do Macaron é o ancoramento contrafactual. Essa ideia surge da necessidade de manter a coerência sem fundir tudo em um modelo de usuário sintetizado. Como garantimos que a IA tenha um senso estável do usuário (seu estilo, prováveis preferências, valores) se evitamos deliberadamente criar um único perfil agregado? A resposta é usar cenários contrafactuais para ancorar aspectos-chave da persona do usuário no raciocínio da IA, em vez de fatos armazenados explicitamente.

Na prática, o ancoramento contrafactual pode funcionar assim: o Cérebro do Macaron, ao gerar uma resposta ou tomar uma decisão, testa internamente algumas variações de "e se" para avaliar a consistência. Por exemplo, suponha que o Macaron está prestes a sugerir um livro ao usuário. A IA não tem uma regra rígida de "O usuário gosta apenas de ficção científica." Em vez disso, pode lembrar de vários sinais passados: o usuário gostou de certos romances de ficção científica, mas também mencionou uma vez gostar de mistério. Para evitar estar errado, a IA pode simular duas saídas contrafactuais – uma onde assume que o usuário está com humor para ficção científica, outra onde ele pode preferir mistério – e ver qual delas se alinha melhor com o contexto recente ou recebe uma previsão de sentimento positivo. Esse raciocínio contrafactual interno ajuda a ancorar a escolha da IA em uma avaliação robusta dos possíveis estados do usuário, em vez de uma suposição estreita. É como se a IA dissesse, "Não tenho 100% de certeza de quem você é agora, mas se você ainda for o fã de ficção científica que parecia ser, você vai gostar de X; se mudou, pode gostar de Y. Vamos escolher a sugestão que mais se encaixa no tom da conversa atual." Na prática, a IA está se protegendo contra a fragilidade de um único modelo de identidade, explorando alternativas de quadros de identidade instantaneamente.

Outra utilização do ancoramento contrafactual é na manutenção da voz e dos valores do usuário. O Macaron evita sintetizar um perfil de usuário unificado que diga 「O usuário é sempre formal」 ou 「O usuário tem posição política Z」 – isso seria frágil e possivelmente invasivo. Em vez disso, ao compor uma saída (por exemplo, redigir um e-mail para o usuário), o Macaron pode gerar algumas variantes estilísticas (formal, casual, humorístico) e verificá-las em relação a um modelo leve das comunicações recentes do usuário para ver qual delas parece mais 「em sintonia com o usuário」. Isso atua como um ancoramento: a IA não armazena 「O usuário é formal」 permanentemente, mas pode inferir a partir do contexto que, neste momento, um tom formal corresponde aos e-mails da semana passada. Se no próximo mês o estilo do usuário mudar, a verificação contrafactual naturalmente captará isso e ajustará, sem a necessidade de reescrever alguma variável de perfil. A continuidade do usuário é assim mantida por pequenos alinhamentos constantes em vez de um plano estático.

A ancoragem contrafactual é algo semelhante à forma como os humanos navegam na identidade em diferentes situações – muitas vezes imaginamos subconscientemente 「como eu agiria se fosse o tipo de pessoa que...?」 o que, na verdade, ajuda a esclarecer quem escolhemos ser. Para o Macaron, essas micro-simulações garantem coerência testando suposições em vez de simplesmente aceitá-las. O resultado é coerência sem calcificação: o Cérebro do Macaron pode agir de forma consistente 「como o usuário do Macaron」 sem nunca armazenar uma definição fixa de 「usuário do Macaron.」 A coerência emerge de um alinhamento repetido e instantâneo.

Coerência Sem Síntese Centralizada

Dando um passo atrás, a combinação de limites distribuídos, decadência referencial, trançamento temporal e ancoragem contrafactual servem a um objetivo abrangente: manter a coerência e a continuidade sem um modelo de usuário centralizado ou perfil de persona sintético. Esta é uma filosofia deliberada. Muitos sistemas de IA tentam construir perfis extensivos de usuários ou ajustar modelos com base nos dados do usuário para criar um 「modelo pessoal.」 O Macaron evita explicitamente ajustar um modelo monolítico com todos os dados do usuário; em vez disso, mantém os dados segmentados e usa meta-modelos para costurar as respostas. Existem algumas razões para essa evitação de síntese:

Privacidade e Confiança: Um perfil comportamental centralizado pode ser um atrativo de dados pessoais e levantar preocupações de privacidade (quem tem acesso, e se estiver errado ou for usado de maneiras não intencionais?). Ao não ter um, o Macaron garante que cada dado seja usado apenas no contexto, e a compreensão do sistema é intrinsecamente descentralizada. Está mais próximo do princípio de minimização de dados - usar apenas o que é necessário quando necessário, em vez de acumular um perfil mestre.

Evitando o Overfitting da Identidade: As pessoas são complexas e mutáveis. Um único modelo treinado em todos os dados passados provavelmente overfit ao passado do usuário, tornando a IA menos adaptável ao futuro deles. O Macaron mantém seu núcleo generativo como um modelo geral, aumentado com dados específicos de contexto em tempo real (estilo Geração Aumentada por Recuperação). Isso significa que a "visão" do usuário pelo Macaron é sempre uma função de recuperações atuais, e não uma rede estática super treinada. O usuário pode se reinventar e o Macaron acompanhará, porque o Macaron não está preso ao ajuste fino de ontem. Em essência, evitamos que a IA se torne uma caricatura do passado do usuário.

Transparência e Controle: Quando não há um modelo único sintetizado, é mais fácil inspecionar e controlar o que a IA está usando para formar respostas. O Macaron pode mostrar, se necessário, quais fragmentos de memória foram recuperados para uma consulta, proporcionando transparência. Se um usuário disser "esquecer este evento", podemos apagar essa memória e ela realmente desaparece do uso futuro. Em um modelo sintetizado centralmente, apagar um fato é difícil (você não pode facilmente fazer com que uma rede neural "desaprenda" um detalhe sem re-treinamento). Ao evitar a síntese central, o Cérebro do Macaron permanece mais editável e interpretável.

Ainda assim, apesar de não ter um perfil unificado, o Macaron alcança um tipo de unidade: uma continuidade de personalidade. A IA pessoal do usuário responde de uma maneira que parece consistente e exclusivamente sua. Como isso é possível? Principalmente através das facilidades arquitetônicas que descrevemos: o sistema dinamicamente extrai as peças certas de memória e as usa para moldar saídas (assim o conteúdo é personalizado), e utiliza técnicas como correspondência de estilo e verificações contrafactuais para garantir que o tom e a abordagem estejam alinhados com o caráter do usuário. Outros projetos de IA pessoal também defendem modelos específicos para cada usuário funcionando isoladamente, efetivamente um modelo por usuário, para garantir a personalização sem agrupar dados. A abordagem do Macaron é sutilmente diferente – em vez de treinar um modelo distinto por usuário (o que é outra forma de centralização, apenas por usuário), o Macaron usa um modelo base compartilhado com pods de memória por usuário e personalização instantânea. Isso proporciona benefícios de personalização semelhantes (os dados de cada usuário são separados, os modelos podem se adaptar à linguagem individual) mas sem a necessidade de treinar ou ajustar um novo para cada usuário, e sem consolidar todo o conhecimento em pesos difíceis de auditar.

O resultado é um sistema que mantém coerência como se tivesse um eu, mas esse 「eu」 não é um único objeto ou arquivo – é um fenômeno emergente. O Cérebro do Macaron demonstra que você pode ter os benefícios de uma persona persistente (a IA 「lembra」 estilo, preferências, histórico) enquanto mantém a fluidez e impermanência que respeitam a identidade humana real. O eu é sustentado por estrutura e processo, não por armazenamento estático.

Implicações para Agência Pessoal e Personalidade Digital

A arquitetura do Cérebro do Macaron tem implicações mais amplas. Em primeiro lugar, ela fortalece a agência pessoal. O usuário permanece no controle de sua narrativa em evolução. Como a IA não impõe um perfil rígido, o usuário pode mudar hábitos, opiniões, até aspectos de identidade, e a IA se adaptará em vez de resistir ou insistir com 「Mas você disse uma vez...」. Essa dinâmica é crucial para uma parceria saudável de longo prazo entre humanos e IA. Trata o usuário como um protagonista em crescimento de sua história, não como pontos de dados fixos. A IA torna-se uma estrutura de apoio que sustenta a continuidade do eu do usuário, em vez de um espelho que os prende em reflexões passadas.

Do ponto de vista da pessoa digital, a abordagem do Macaron sugere um modelo para o que constitui um 「eu digital」. Não é um único duplo de dados (não é uma cópia da pessoa em um servidor), mas sim um processo que se desenrola ao longo do tempo e do contexto. Se algum dia a sociedade e a lei reconhecerem a continuidade pessoal assistida por IA – por exemplo, se uma IA pudesse ser vista como parte da mente estendida de alguém ou até mesmo ter um tipo de personalidade dependente – provavelmente será por causa de arquiteturas como esta. Elas demonstram que uma IA pode ter continuidade sem uma identidade única: assim como uma corporação é uma pessoa jurídica composta por muitas partes e processos, uma IA pessoal poderia ser vista como parte da identidade da pessoa sem ser um clone de dados direto.

Curiosamente, o status legal de tais personas digitais permanece indefinido. Como observou um comentarista, futuras pesquisas jurídicas devem lidar com questões em torno da personalidade digital e das responsabilidades ou direitos associados a agentes de IA que atuam como parte da identidade de alguém. O Brain da Macaron oferece um estudo de caso para uma abordagem responsável: ao evitar perfis comportamentais centralizados, evita muitas preocupações éticas e legais (como viés de perfil ou a IA 「sair do controle」 com informações desatualizadas). Se algum dia uma IA pessoal for considerada para reconhecimento legal (por exemplo, sendo capaz de realizar certas ações em nome de um usuário de forma autônoma), uma arquitetura que mantenha coerência por meio de memória responsável em vez de modelos de persona inescrutáveis será muito mais fácil de justificar e confiar.

Outra implicação é a continuidade após a morte ou durante longas ausências. Se um usuário do Macaron ficar inativo por um ano e retornar, a IA pode reviver a essência de sua identidade de forma contínua a partir da memória armazenada (com referências decaídas, mas não apagadas). Se um usuário falecesse e sua família continuasse o diálogo, a IA não seria a pessoa (nem o Macaron tenta isso), mas levanta a questão: quanta continuidade é suficiente para uma presença significativa? Já vemos exemplos de avatares digitais de entes queridos, onde 「a linha entre origem e eco se dissolve no diálogo,」 como uma análise de seres digitais sugeriu. O cérebro do Macaron poderia, em teoria, facilitar uma espécie de continuidade digital – embora o uso ético provavelmente se limitasse ao benefício do usuário vivo (por exemplo, ajudando você a lembrar seus próprios eventos de vida de forma coerente nos anos posteriores).

Finalmente, ao não limitar o usuário a um perfil, o design do Macaron reconhece implicitamente uma postura filosófica: a identidade é construída, contínua e dependente do contexto. Isso ressoa com visões pós-modernas de que não há um eu imutável central, apenas um eu narrativo. O Cérebro do Macaron é um motor narrativo nesse sentido. Para os usuários, isso pode ser libertador – significa que sua IA evolui com eles, co-criando uma narrativa em vez de impor uma. Isso também significa que a IA pode facilitar a autodescoberta: porque pode notar padrões (「Você frequentemente fala com paixão sobre justiça em nossas conversas sobre trabalho e assuntos pessoais」), mas não os afirma como verdades estáticas, ela pode refletir suavemente os valores aparentes do usuário e permitir que o usuário os afirme ou redefina. O usuário continua sendo o autor; a IA é uma editora muito sofisticada e rastreadora de continuidade.

Conclusão

Do substrato ao eu – percorremos a jornada desde os mecanismos de memória subjacentes do Macaron até o surgimento de um "eu" pessoal contínuo, apoiado pela arquitetura Brain. Vimos que a continuidade não precisa vir de um armazenamento permanente de fatos ou de um modelo de usuário monolítico. Em vez disso, o Macaron confia em uma abordagem mais orgânica: memórias que desvanecem a menos que sejam renovadas, limites que compartimentalizam experiências mas permitem comunicação, tempo que é tratado como uma dimensão do conhecimento, e raciocínio contrafactual para ancorar decisões em uma compreensão flexível do usuário. O resultado é uma IA pessoal que é consistente mas não restritiva, coerente mas não estática.

Esta foi uma exploração necessariamente teórica, porque tal comportamento de ordem superior está na vanguarda do design de IA pessoal. No entanto, está fundamentada em princípios concretos: privacidade (sem perfis centralizados), função de memória semelhante à humana (lembrar e esquecer) e aprendizado adaptativo. O Brain do Macaron evita centralizar modelos de usuário ou perfis comportamentais não apenas por privacidade, mas porque não é assim que a verdadeira continuidade pessoal funciona. Ao manter a coerência sem síntese, o Macaron garante que o usuário seja quem, em última instância, tece o fio da continuidade, com a IA fornecendo o tear e as mãos suaves que guiam os fios.

Olhando para o futuro, à medida que as IAs pessoais se tornam mais prevalentes, podemos descobrir que apenas aquelas projetadas com essa continuidade fluida conquistarão a confiança a longo prazo dos usuários. Uma IA que nunca esquece e nunca muda seria inquietante; uma que esquece demais, frustrante. A aspiração do Macaron é acertar – lembrar o que importa, esquecer o que não importa e acompanhar o usuário ao longo do tempo como um parceiro fiel, mas em evolução. Ao fazer isso, chegamos mais perto de uma visão onde os sistemas digitais respeitam e reforçam a continuidade do eu, em vez de fragmentá-lo ou congelá-lo. A série Brain traçou essa visão: desde a rejeição da metáfora do banco de dados até a construção de um substrato dinâmico, alimentando algo que começa a parecer um 「eu」. As implicações continuarão a se desenrolar, mas uma coisa é clara – o caminho para uma IA pessoal que realmente enriquece a vida humana está em abraçar a complexidade da identidade e da memória, arquitetando para mudança e continuidade juntas. O Brain do Macaron é um experimento contínuo nessa direção, uma estrutura para um eu que permanece seu, mesmo enquanto cresce com você.