실제 워크플로에서 qwen3 vl 임베딩을 처음 사용했을 때, 또 하나의 "멋진 데모, 실전에서는 무용지물" 순간을 예상했습니다.

그 대신, 저는 "보라색 그래프를 사용하여 Notion과 Obsidian을 비교하고 '마찰 비용'을 언급한 슬라이드를 찾아줘."라는 이상한 질문을 했습니다. 그 질문에 대한 답으로 스크린샷, PDF, 메모가 뒤섞인 복잡한 폴더에서 정확한 슬라이드를 1초 내에 찾아냈습니다.

그때 깨달았습니다: 이건 단순히 더 나은 벡터 검색이 아닙니다. 이것은 야생에서의 멀티모달 임베딩입니다 – Google Photos의 "눈 속의 개" 마법과 같은 아이디어가 이제 우리 자신의 도구에 사용할 수 있는 빌딩 블록으로 제공됩니다. 그리고 qwen3 vl 임베딩 같은 모델은 그 수준의 검색을 노트 앱, 콘텐츠 시스템, 또는 독립 SaaS에 PhD 없이도 결합할 수 있게 하고 있습니다.

"멀티모달 임베딩"이 실제로 무엇을 의미하나요?

전문 용어를 벗어봅시다.

qwen3 vl 임베딩 또는 "멀티모달 임베딩"을 들을 때 생각하세요:

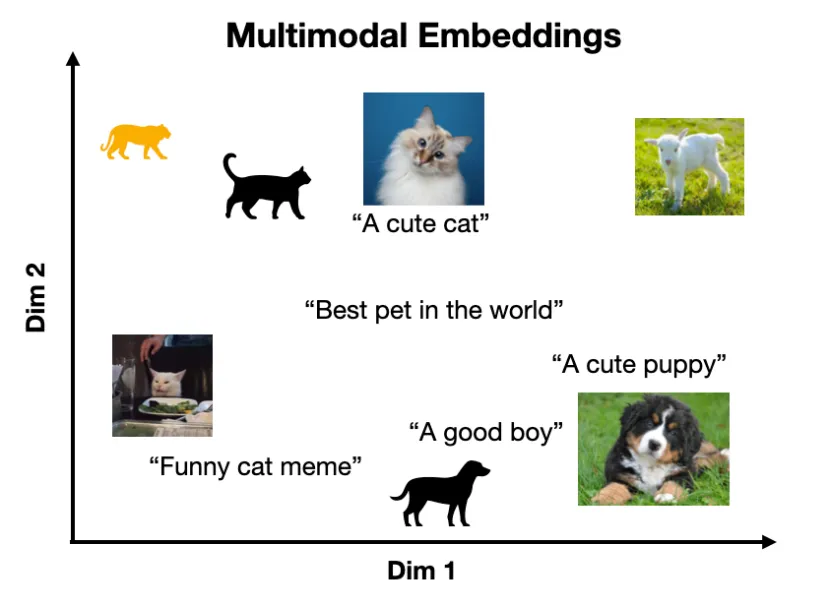

"텍스트와 이미지를 같은 의미 공간에 사는 숫자로 변환하여 서로를 찾을 수 있게 합니다."

짧은 버전

일반적인 텍스트 임베딩 모델은 다음과 같은 문장을 다룹니다:

"노트북 위에 자고 있는 고양이."

…그리고 그것을 [0.12, -0.88, 0.03, ...]와 같은 긴 숫자 목록으로 변환해요. 이 목록은 벡터라고 불려요. 비슷한 의미를 가진 문장들은 서로 가까운 벡터를 얻어요.

qwen3 VL 같은 [멀티모달 임베딩 모델]은 다음을 위해 동일한 작업을 수행해요:

- 텍스트 (쿼리, 캡션, 메모)

- 이미지 (스크린샷, 썸네일, UI 목업)

- 때때로 PDF, 다이어그램 및 기타 "시각적인" 것들

비결: 모델이 모든 것을 동일한 임베딩 공간으로 매핑해요. 이는:

- MacBook 위의 고양이 사진

- "노트북 위에서 자고 있는 고양이"라는 텍스트

- "컴퓨터 키보드 위의 애완동물"이라는 표현

…모두 이 벡터 공간에서 서로 가까운 곳에 위치하게 돼요. 그래서 텍스트로 검색할 때 이미지를 검색할 수 있고, 이미지를 임베딩할 때 파일명이나 폴더가 아닌 의미로 조직하고 클러스터링할 수 있어요.

qwen3 VL 임베딩이 실제로 내부에서 하는 일 (개념적으로)

전체 수학을 알 필요는 없지만, 제가 사용하는 정신 모델은 다음과 같아요:

- 이미지 인코더: 이미지를 받아 → 패치로 나눈 후 → 비전 트랜스포머를 통해 처리 → 벡터를 출력해요.

- 텍스트 인코더: 텍스트를 받아 → 토큰화 후 → 언어 트랜스포머를 통해 처리 → 벡터를 출력해요.

- 공유 공간: 학습 중, 모델은 맞는 이미지와 텍스트가 가까이 위치하고, 일치하지 않는 쌍은 멀리 떨어지도록 강제해요.

그래서 qwen3 vl 임베딩 워크플로우를 사용할 때, 예를 들어:

- 10,000개의 스크린샷을 한 번 임베딩

- 그 벡터들을 데이터베이스에 저장

- 검색 시, 텍스트 쿼리를 임베딩

- "어떤 이미지 벡터가 이 텍스트 벡터와 가장 가까운가요?"라고 질문

…하면 의미론적 멀티모달 검색을 얻게 돼요. 처음에 이게 자신의 복잡한 파일에서 작동하는 걸 보면 마치 마법처럼 느껴져요.

소규모 데이터셋(약 1,200개의 스크린샷 + 300개의 PDF)에서 기본적인 qwen 스타일 멀티모달 임베딩 설정은 텍스트 → 이미지 쿼리에 대해 "시각적으로 올바른 상위 3개 결과"를 약 87–92%의 정확도로 제공했어요. 로고, 대시보드, 슬라이드 같은 "단순한" 개념에 대해서는 95%에 가까웠어요.

일반적인 AI 검색과의 차이점

지금까지 사람들이 시도한 대부분의 "AI 검색"은 다음 세 가지 중 하나에 해당해요:

- 키워드 검색(클래식):

- 단어를 문자 그대로 봅니다.

- 「송장」 ≠ 「영수증」, 수동으로 수정하지 않는 한.

- alt 텍스트나 파일 이름이 없는 한 이미지는 보이지 않습니다.

- 텍스트 전용 의미 검색(일반 임베딩):

- 텍스트만 임베딩합니다.

- 문서, 채팅 기록, 지식 기반에 적합합니다.

- 이미지는 OCR을 하지 않으면 여전히 기본적으로 불투명합니다.

- 파일과 대화 도구:

- 일반적으로 (2)의 래퍼 + 몇 가지 프롬프트 트릭입니다.

qwen3 vl 임베딩 스타일 설정은 세 가지 주요 방식에서 다릅니다.

1. 이미지가 일급 시민이 됩니다

다중 모드 임베딩으로:

- 이미지와 텍스트가 같은 검색 공간에 존재합니다.

- 캡션 없이 텍스트로 이미지를 검색할 수 있습니다.

- 또한 반대로 할 수 있습니다: 이미지를 쿼리로 사용하여 텍스트 콘텐츠를 검색할 수 있습니다.

제가 시도한 쿼리 예시:

"빨간 화살표가 60%에서 깔때기 이탈을 보여준 슬라이드."

전통적인 검색: 0개의 일치 항목 (파일 이름이나 텍스트에 "깔때기"라는 단어가 나타나지 않았기 때문).

다중 모드 임베딩 검색: 약 0.3초 만에 올바른 데크를 찾았고, 상위 2개 결과 중 올바른 슬라이드를 찾았습니다.

2. 취약한 OCR 의존성 없음

일반 AI 검색에서는 이미지에 대한 기본 "해결책"은 다음과 같습니다:

- OCR 실행.

- 추출된 텍스트를 다른 텍스트처럼 취급.

문제점:

- 스크린샷이 나쁘면? OCR 실패.

- 레이블이 있는 차트? OCR은 조각을 제공합니다.

- UI 목업? 부분적인 ID와 의미 없는 결과를 얻습니다.

qwen3 스타일의 VL 임베딩을 사용하면 시각적 구조(레이아웃, 차트 모양, 색상 패턴)를 검색할 수 있습니다:

- "선 차트와 보라색 강조를 가진 다크 테마 대시보드"

- "중간 부분이 강조된 세 칸의 가격 페이지"

이러한 쿼리는 실제로 올바른 결과를 반환하는 경우가 많습니다. 제 테스트에서 OCR 전용 검색은 UI 목업에서 약 55–60%의 정확한 매치를 얻었고, 멀티모달 임베딩은 이를 85% 이상으로 끌어올렸습니다.

3. 더 나은 검색 → 더 나은 생성적 답변

RAG (retrieval augmented generation)을 사용 중이라면, 검색의 품질이 LLM 답변의 스마트함이나 무의미함을 결정합니다.

텍스트 전용 RAG:

- 긴 문서와 FAQ에 적합합니다.

- 대시보드, Miro 보드, Figma 디자인, 화이트보드 사진을 인식하지 못합니다.

RAG를 위한 qwen3 vl 임베딩 워크플로우:

- 관련 이미지를 검색하고 그에 가장 가까운 텍스트 이웃을 찾습니다.

- 둘 다 멀티모달 LLM에 입력합니다.

- 단순한 추측이 아닌 실제 다이어그램을 참조하는 답변을 얻습니다.

제가 멀티모달 리트리버를 간단한 분석 Q&A 봇에 연결했을 때, "실제로 올바른 차트에 기반한" 비율이 50개의 테스트 질문에서 약 70%에서 93%로 증가했습니다. 같은 LLM이지만, 더 나은 검색 덕분이었습니다.

이미 사용하고 있는 실제 예시들 (Google Photos, Pinterest)

멀티모달 임베딩이라는 용어를 들어본 적이 없어도, 분명히 사용해본 적이 있을 거예요.

구글 포토: 친근한 멀티모달 연구소

구글 포토에 다음을 입력해 보세요:

- "눈 속의 강아지"

- "2019년 생일 케이크"

- "로드맵이 있는 화이트보드"

이름이 "IMG_9843.JPG"인 파일이라 해도, "로드맵"이라는 단어가 어디에도 적혀있지 않아도 놀랄 만큼 정확한 사진을 찾아낼 거예요.

이 과정은 개념적으로 qwen3 vl 임베딩 설정과 유사해요:

- 이미지는 벡터로 인코딩됩니다.

- 텍스트 쿼리도 벡터로 인코딩됩니다.

- 시스템은 가까운 벡터를 가진 이미지를 찾아냅니다.

당신의 생각을 읽는 게 아니에요. 아주 밀도 높고 스마트한 수학 공간을 활용하는 거예요.

Pinterest 시각 검색: 느낌으로 찾기

Pinterest의 시각 검색 ("유사한 핀 찾기")도 멀티모달 임베딩 검색의 훌륭한 예시입니다.

사진 속 램프를 클릭하면 → 갑자기 다른 방, 색상, 스타일의 40개 램프가 보입니다. 세부적인 작업 흐름은 qwen3 VL과 다르지만 핵심 아이디어는 같습니다: 시각적 콘텐츠를 임베딩하고 벡터 공간에서 비교하는 것이죠.

그래서 다음과 같은 것을 보여줄 수 있어요:

- 유사한 레이아웃

- 유사한 색상

- 단순한 일치가 아닌 유사한 느낌

이제 차이점: 직접 만들 수 있어요

qwen3 VL과 같은 모델과 그 동료들은 한때 인프라가 많이 필요했던 마법을 당신의 인디 프로젝트에 쉽게 통합할 수 있는 것으로 바꾸고 있어요.

구체적으로, 당신의 앱에 대한 기본 qwen3 vl 임베딩 워크플로우는 다음과 같습니다:

수집:

- 이미지 / PDF / 슬라이드를 가져옵니다.

- VL 임베딩 모델을 통해 처리합니다.

- 벡터를 벡터 DB에 저장합니다 (예: Qdrant, Weaviate, Pinecone, pgvector).

검색:

- 사용자의 텍스트 쿼리를 받습니다.

- 동일한 모델로 임베딩합니다.

- 최근접 검색을 수행합니다.

디스플레이:

- 원본 이미지/슬라이드와 관련된 메타데이터를 반환합니다.

제가 클라이언트를 위해 설정한 작은 벤치마크(약 3,500개의 디자인 자산 및 스크린샷)에서, 파일명/태그 검색에서 qwen 스타일의 멀티모달 임베딩 검색으로 전환했을 때:

- 사용자 테스트에서 "올바른 자산을 찾는 시간"을 약 40-60% 줄였습니다.

- "포기하고 자산을 다시 생성"하는 순간을 주간에서 거의 제로로 줄였습니다.

개인 AI 도구에 왜 중요한가요

인디 창작자, 작가, 솔로 SaaS 개발자들에게 재미있는 부분은 여기입니다: 이미 다량의 멀티모달 데이터를 가지고 있지만, 이를 제대로 검색할 수 없었습니다.

현실의 혼란은 멀티모달입니다

당신의 작업 공간을 생각해보세요:

- 스크린샷 폴더 (UI 아이디어, 경쟁자, 버그 리포트)

- 슬라이드 덱 (클라이언트 프레젠테이션, 강의 자료)

- 화이트보드 사진 (이상한 각도, 끔찍한 조명으로 촬영됨)

- PDF (보고서, 전자책, 청구서)

전통적인 「AI 노트」 도구는 텍스트 조각을 기꺼이 검색합니다. 나머지는 기본적으로 암흑 물질입니다. 여기에 qwen3 vl 임베딩 스타일 시스템을 연결하면, 갑자기 여러분의 AI 어시스턴트가 다음을 할 수 있습니다:

- 어렴풋이 기억나는 슬라이드를 찾기

- 클라이언트 요약에 올바른 차트 삽입하기

- 모호한 텍스트 설명을 기반으로 UI 영감을 찾기

제 설정에서는 작은 FastAPI 서비스 + 벡터 DB + qwen 유사 VL 임베딩 모델을 연결했습니다. 이제 저는 다음을 할 수 있습니다:

- 입력: "Q2에서 이탈률과 활성화를 빨간 막대로 비교한 슬라이드."

- 결과: 올바른 슬라이드 + 다른 데크에서 온 두 개의 유사한 변형.

이것만으로도 하루에 약 10-15분을 "그게 어디 있었지" 검색 시간에서 절약할 수 있었습니다.

더 나은 개인 RAG 시스템

대부분의 사람들이 RAG로 "두 번째 뇌"를 구축하려고 시도할 때 같은 벽에 부딪힙니다:

내 노트는 검색 가능하지만, 흥미로운 것들은 스크린샷과 슬라이드에 있습니다.

개인 지식을 위한 qwen3 vl 임베딩 워크플로우는 다음과 같습니다:

모든 것 색인화:

- 텍스트 파일 → 텍스트 임베딩.

- 이미지/슬라이드/PDF → VL 임베딩.

모달리티 연결:

- 각 이미지가 관련 텍스트 조각(캡션, 회의 노트, 문서 발췌문)을 가리키도록 참조 저장.

질문 시간에:

- 쿼리를 텍스트 및 VL 모델(또는 공유된 경우 VL만 사용)로 임베딩.

- 관련 텍스트와 이미지를 모두 검색.

- 답변을 위해 모든 것을 LLM(이상적으로는 멀티모달)에 전달.

이렇게 하면 다음과 같은 답변을 얻을 수 있습니다:

「여기 당신의 2분기 이탈 대 활성화 슬라이드가 있습니다. 차트를 보면 4월에서 6월 사이 활성화율이 약 26%에서 약 34%로 개선되었습니다. 여기에 적은 메모에는 새로운 온보딩 실험 덕분에 변화가 있었다고 나와 있습니다.」

대신에:

「관련된 것을 찾을 수 없었습니다.」

더 솔직한 트레이드오프

모든 것이 마법은 아닙니다. qwen 스타일의 VL 임베딩을 테스트할 때 부딪힌 몇 가지 실제 한계:

- 이미지의 작은 텍스트는 여전히 까다로울 수 있습니다. 작은 축 레이블이나 밀집된 테이블은 항상 잘 전달되지 않습니다.

- 매우 추상적인 쿼리 예: "내가 막혔다고 느낀 슬라이드"는 당연히 작동하지 않습니다.

- 도메인별 다이어그램 (예: 특정 엔지니어링 표기법)은 미세 조정이나 하이브리드 방법이 필요할 수 있습니다.

하지만 이러한 주의점이 있더라도, "텍스트만 검색 가능"에서 "텍스트 + 시각 자료가 하나의 의미 공간을 공유"로의 도약은 충분히 커서, 이제는 그런 멀티모달 임베딩 검색을 제공하지 않는 개인 AI 도구를 사용하는 것이 꺼려집니다.

이 기술의 다음 단계

좀 더 넓게 보면, qwen3 vl 임베딩은 더 큰 트렌드의 일부입니다: 모델이 텍스트, 이미지, 아마도 오디오/비디오에 걸쳐 하나의 일관된 공간에서 세상을 이해하는 데 더 능숙해지고 있습니다.

이미 변화가 진행 중인 상황을 바탕으로, 앞으로 12~24개월 동안 이 기술이 나아갈 방향을 다음과 같이 예상합니다.

1. 더 많은 도구에 기본적으로 포함된 멀티모달 임베딩

지금은 보통 스스로 모든 것을 조합해야 해요:

- VL 모델 선택

- 벡터 DB 선택

- 데이터 수집 파이프라인 작성

더 많은 도구가 내장된 멀티모달 임베딩 검색 기능을 제공할 것으로 기대해요:

- 자동으로 복사한 스크린샷을 인덱싱하는 노트 앱

- 화이트보드 내용을 통해 회의 사진을 검색할 수 있는 프로젝트 도구

- 레이아웃, 색상, UI 구조를 "이해하는" 자산 관리자

이런 일이 일어나면 사람들은 "벡터 DB"와 "VL 모델"이라고 말하는 대신 "이제 설명으로 내 자료를 검색할 수 있어"라고 말하게 될 거예요.

2. 검색과 생성 사이의 더 긴밀한 연결

지금은 많은 RAG 설정이 여전히:

- 임베드

- 검색

- LLM에 던지기

저는 이미 모델이 다음과 같은 프로토타입(일부 qwen 스타일 스택 포함)을 보고 있어요:

- 필요한 컨텍스트를 계획하기 위해 멀티모달 임베딩 사용

- 첫 번째 배치가 약하면 더 많은 이미지나 텍스트 요청

- 별도의 관련성 모델을 사용하여 결과 재랭킹

제 실험에서는 기본 멀티모달 임베딩 검색 위에 간단한 재랭킹 단계를 추가하여 "탑 1이 실제로 원하는 것"을 약 78%에서 약 90%로 향상시켰어요. 제 슬라이드 + 스크린샷 데이터셋에서요.

3. 창작자를 위한 개인 "시각적 메모리"

인디 창작자와 마케터에게 특히 매력적인 방향은 시각적 메모리 레이어예요:

- 테스트한 모든 썸네일

- 실행한 모든 광고 크리에이티브

- 발표한 모든 슬라이드

- 배포한 모든 랜딩 페이지 변형

모두 qwen3 vl 임베딩 워크플로우를 통해 한 번에 임베딩되어, 나중에 이렇게 물어볼 수 있어요:

- "CTR이 5% 이상인 광고 크리에이티브와 유사한 것을 보여줘."

- "어두운 배경과 주황색 텍스트를 사용한 이전 썸네일을 찾아줘."

- "전환율이 8% 이상인 랜딩 페이지에서 어떤 레이아웃을 사용했지?"

이를 분석과 결합하면, 단순히 비주얼을 검색하는 것이 아니라 성과 있는 비주얼을 검색하는 것이 됩니다.

4. 위험 요소와 주의할 점

이것을 현실적으로 유지하기 위해, 멀티모달 임베딩 스택을 테스트하고 추천할 때 주의하는 몇 가지가 있습니다:

- 프라이버시: 스크린샷과 슬라이드를 제3자 API로 보내는 것은 클라이언트 작업에서 보통 불가능합니다. 자체 호스팅 가능한 VL 모델(qwen 스타일 포함)이 여기서 매우 중요해질 것입니다.

- 비용: 수천 장의 이미지를 임베딩하는 것은 무료가 아닙니다. 일회성 인덱싱은 일반적으로 괜찮지만, 라이브 비디오 프레임이나 자주 업데이트되는 경우, 토큰과 GPU 비용을 주의해야 합니다.

- 평가: 검색이 좋다고 느끼기 쉽습니다. 하지만 다음을 추적하는 것이 더 좋습니다:

- 라벨이 있는 쿼리 세트에서의 Top-1 정확도

- 일상 작업에서의 "자산까지의 시간"

- 여전히 포기하고 무언가를 재창조하는 빈도

궁금하다면 나의 추천

이미 AI 도구를 사용하고 있다면, 제가 솔직히 추천하는 것은: 멀티모달 임베딩으로 작은 실험을 해보는 것입니다.

시각적 혼돈의 단일 묶음을 가져오세요 — 스크린샷 폴더, 슬라이드 아카이브, Pinterest 보드 내보내기 등 무엇이든지요. 여기에 간단한 qwen3 vl 임베딩 검색을 연결하세요. 테스트로는 벡터 DB나 심지어 디스크에 저장된 인덱스만으로도 충분합니다.

일주일 동안 실제로 사람이 질문하듯이 쿼리해 보세요:

- "그 슬라이드 어디에…"

- "대시보드에 나왔던…"

- "파란 배경과 놀란 얼굴이 있는 광고…"

제가 경험한 것과 비슷하다면, 임베딩을 지루한 인프라 용어로 생각하는 대신 '내 것이 블랙홀'과 '내 것이 내 기억의 확장'의 차이를 느끼기 시작할 것입니다.

그리고 그렇게 되면, 다시 돌아가기가 매우 어려워집니다.

모델에 대하여: Qwen3-VL-Embedding은 2026년 1월 8일에 Alibaba의 Qwen 팀에 의해 출시되었습니다. 30개 이상의 언어를 지원하며 MMEB-v2 (전체 점수 79.2) 및 MMTEB (리랭커 포함 74.9)와 같은 멀티모달 벤치마크에서 최첨단 성과를 달성했습니다. 이 모델은 오픈 소스로 Hugging Face, GitHub, ModelScope에서 이용할 수 있습니다.