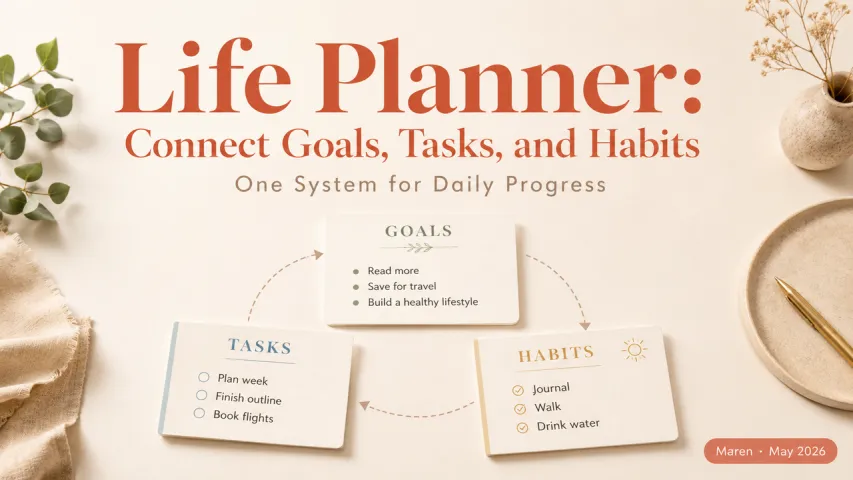

Apple Intelligence 2.0: iOS 19.2의 오프라인 LLM과 '장면 메모리'

작성자: Boxu Li

iOS 19.2, 개인 AI 업그레이드 – 왜 화제일까요?

Apple의 iOS 19.2 업데이트가 기술 애호가들 사이에서 큰 화제를 모으고 있습니다. 그 이유는 이 업데이트가 지난 1년 동안 도입된 "Apple Intelligence" 기능을 강력한 온디바이스 대형 언어 모델(LLM)과 새로운 "장면 메모리" 기능으로 강화하기 때문입니다. 쉽게 말해, 이제 iPhone이나 iPad가 클라우드에 의존하지 않고 훨씬 더 똑똑해졌습니다. 사용자는 이번 업데이트가 Siri와 기타 지능형 기능이 문맥을 더 잘 이해하고 완전히 오프라인으로 작동할 수 있어 프라이버시를 보호할 수 있다는 점에서 매우 기뻐하고 있습니다. 이는 Apple의 AI 전략에서 중요한 도약으로, 최첨단 생성 모델을 일상생활에 통합하면서 사용자 데이터를 기기에 보관합니다[1]. Apple의 프라이버시 우선 접근 방식을 통해 개인 데이터를 서버에 전송하지 않고도 AI 기반의 편리함(고급 Siri 응답, 실시간 번역, 글쓰기 지원, 이미지 생성 등)을 누릴 수 있습니다[2][3]. 이 강력함과 프라이버시의 균형은 Apple의 AI 2.0을 소비자 기술의 잠재적인 게임 체인저로 자리 잡게 했습니다.

소비자 관점에서 iOS 19.2의 AI는 그 어느 때보다 더 지능적이고 상황을 잘 이해하는 느낌입니다. Apple의 마케팅에서는 이를 「우리 모두를 위한 AI, 당신의 iPhone에 바로 내장되어 있습니다」[4]라고 부릅니다. 내부적으로는 업데이트를 통해 새로운 기기 내 기초 모델(Apple의 자체 소형 LLM)과 장면 기억을 제공하며, 이 둘이 보다 자연스럽고 대화적인 상호작용을 가능하게 합니다. 기술 포럼과 소셜 미디어에는 Siri가 이제 대화를 이어가거나 화면에 보이는 내용을 기반으로 행동을 제안하는 등의 사례가 가득합니다. 이 기사에서는 Apple의 기기 내 LLM과 장면 기억의 기술적 실체와 이것이 사용자, 개발자 및 Macaron과 같은 개인 AI 앱에 왜 중요한지를 분석해 보겠습니다. 시작해 봅시다.

Apple Intelligence 2.0이 정확히 무엇인가요?

「Apple Intelligence」는 iOS, iPadOS, macOS 등에 통합된 생성형 AI 기능을 포괄하는 애플의 용어입니다[5]. 처음 iOS 18에서 Writing Tools(AI 기반의 텍스트 필드에서의 교정 및 문장 재구성), Image Playground(텍스트로부터 이미지 생성), 알림 요약, 그리고 Siri에 약간의 ChatGPT 통합과 함께 출시되었습니다[6]. 이것을 일상 작업에 AI 지원을 가져오는 Apple의 해답으로 생각해보세요 - 하지만 로컬에서 안전하게 실행되도록 설계되었습니다. Apple Intelligence 2.0(iOS 19.x의 버전)은 이러한 기능을 크게 확장합니다. 애플에 따르면, 기초는 OS 전반에 걸쳐 기능을 구동하는 새로운 기기 내 대규모 언어 모델입니다[1]. 여기에 더 나아가, 카메라 또는 사진 앱에서 객체 및 텍스트를 인식하는 개선된 시각적 인텔리전스, 더 자연스러운 Siri 대화, 그리고 가장 큰 변화: 기기 전반에 걸친 맥락 인식이 추가되었습니다.

Apple Intelligence 2.0의 주요 기능은 다음과 같습니다:

- 온디바이스 파운데이션 모델 (~30억 개의 매개변수) – 애플이 개발한 생성 AI 모델로, A 시리즈 및 M 시리즈 칩의 뉴럴 엔진에서 실행됩니다. 이 모델은 텍스트 생성, 요약, 번역 등을 로컬에서 수행할 수 있습니다 (인터넷 불필요)[7][3]. 크기는 작지만, 애플은 이 모델을 다양한 작업에서 놀라울 정도로 유능하게 최적화했습니다. 메시지 재작성부터 질문에 답변하는 것까지 가능합니다. (다음 섹션에서 더 자세히 알아보겠습니다.)

- “장면 메모리” (컨텍스트 인식) – Siri와 시스템 인텔리전스는 이제 사용자의 현재 “장면” (사용 중인 것, 화면에 나타나는 것, 최근 상호작용)에서 컨텍스트를 기억하고 활용할 수 있습니다. 예를 들어, Siri는 요청 간 대화의 흐름을 유지하거나[6], 문자로 받은 이벤트 초대장을 볼 때 일정에 추가하라고 제안할 수 있습니다. 내부적으로 애플은 개인 컨텍스트 인식 작업을 진행 중이며, Siri는 메시지, 이메일, 파일, 사진 등을 (장치에서 개인적으로) 추적하여 더 지능적으로 도움을 줄 수 있습니다[8]. 또한 화면 인식 기능을 갖추어 어떤 앱이나 콘텐츠를 보고 있는지 알고 이에 대해 행동할 수 있습니다 (인간 비서가 하는 것과 유사하게)[9]. “장면 메모리”는 이러한 컨텍스트 기능을 포착하여 AI가 현재 장면을 기억하고 이에 따라 반응할 수 있게 합니다.

- AI에 대한 개발자 접근 (파운데이션 모델 SDK) – iOS 19에서 애플은 새로운 프레임워크를 통해 장치 내 LLM을 앱 개발자에게 공개했습니다[10][11]. 이는 큰 변화입니다: 서드파티 앱은 이제 몇 줄의 코드만으로 애플의 AI 뇌를 활용할 수 있으며, 오프라인 자연어 검색이나 앱 내부의 생성 텍스트/이미지 생성 기능을 구현할 수 있습니다. 특히, 이 온디바이스 추론은 클라우드 비용이 없습니다 – OpenAI 등 다른 곳에 비싼 API 호출이 필요 없습니다[12]. 개발자는 인터넷 없이 작동하고 사용자 데이터를 공유하지 않는 AI 기능을 구축할 수 있으며, 이는 애플의 개인정보 보호 약속과 일치합니다.

- 확장된 멀티모달 기술 – 애플의 모델은 단순한 텍스트 챗봇이 아닙니다; 시각 능력도 갖추고 있습니다. iOS 19에서는 이미지와 인터페이스 요소를 이해할 수 있습니다. 예를 들어, 전단지 사진을 찍으면 아이폰의 AI가 텍스트를 분석하여 캘린더 이벤트를 생성합니다 (날짜, 시간, 위치가 자동으로 추출됨)[13]. 실시간 번역 기능은 음성을 듣고 장치 내에서 실시간으로 번역된 텍스트나 오디오를 제공합니다[14]. 이는 LLM이 시각 및 오디오 시스템에 연결되어 있어 읽는 것뿐만 아니라 “보고” “듣는” 만능 비서가 됨을 나타냅니다.

간단히 말해, Apple Intelligence 2.0은 기기를 현장에서 더 스마트하게 만드는 것입니다. 기기가 당신에 대해 더 많이 이해하고(당신의 맥락, 콘텐츠) 즉석에서 콘텐츠를 생성하거나 도울 수 있으며, 모든 AI 처리를 로컬에서 유지합니다. iOS 19.2에 강력한 오프라인 LLM과 컨텍스트 메모리 시스템을 도입한 것은 Apple의 AI 야망에 중요한 순간입니다. 이제 그들이 어떻게 이를 구현했는지 기술적인 부분을 살펴봅시다.

내부 구조: Apple의 기기 내 LLM 작동 방식

대규모 언어 모델을 스마트폰에서 직접 실행하는 것은 큰 과제입니다. 이러한 모델은 보통 거대하고, 자원을 많이 소모하며, 클라우드 데이터 센터에서 실행됩니다. Apple은 모델 압축, 맞춤형 실리콘, 그리고 뛰어난 엔지니어링을 통해 AI의 스마트함을 손에 들어오는 패키지로 압축하여 해결했습니다. 다음은 그 분석입니다:

- 모델 증류 및 크기 – Apple의 핵심 온디바이스 모델은 약 30억 개의 매개변수로[15], GPT-4와 같은 거대 모델(수백억 개의 매개변수)에 비해 훨씬 작지만 여전히 디바이스에 있어서는 "대형" 모델입니다. Apple은 더 큰 "교사" 모델의 지식을 더 작은 "학생" 모델로 이전하는 지식 증류를 사용하여 훈련했을 가능성이 높습니다. 실제로 Apple의 연구 노트에서는 고품질 모델을 효율적으로 훈련하기 위해 혼합 전문가(MoE) 접근 방식을 사용하여 3B 모델을 희소한 64명의 전문가 모델로 업사이클하여 교사로 활용하고 거대한 밀집 모델이 필요하지 않도록 설명하고 있습니다[16]. 스마트한 교사-학생 전략(서버 모델을 위한 14조 개의 토큰 훈련 데이터 포함)을 사용하여 Apple은 3B 매개변수에 놀라운 성능을 끼워 넣을 수 있었습니다[16][17]. 번역: Apple은 작은 두뇌가 큰 두뇌처럼 작동하도록 가르쳐 크기를 대폭 줄이면서도 똑똑함을 유지했습니다.

- 속도를 위한 아키텍처 최적화 – 모델을 디바이스에서 더 빠르게 실행하려면 Apple은 단순히 모델을 축소하는 것뿐 아니라 모델의 일부를 재설계했습니다. 예를 들어, 모델은 두 블록으로 나뉘어 메모리(Transformer의 "키-값 캐시")가 레이어 간에 더 효율적으로 공유될 수 있도록 했습니다[18]. 이 조정만으로도 캐시 메모리 사용량을 약 37.5% 줄였고 응답의 첫 번째 토큰을 생성하는 시간을 단축했습니다[18]. 또한 긴 컨텍스트 입력을 더욱 효과적으로 처리하기 위해 교차 주의 메커니즘(로컬 주의 창과 전역 주의 레이어 결합)을 구현하여 느려지거나 과도한 RAM 사용 없이 처리할 수 있도록 했습니다[19]. 이는 모델이 더 긴 "기억"을 가질 수 있게 되어 (매우 긴 프롬프트나 문서를 지원) 여전히 디바이스에서 효율적으로 실행되는 것이 중요합니다.

- 양자화 및 압축 – 아이폰에 LLM을 맞추는 가장 큰 열쇠는 모델 가중치의 공격적인 양자화입니다. Apple은 양자화 인식 훈련을 통해 모델의 주요 매개변수에 2비트 가중치 양자화를 적용하여 모델을 원래 크기의 일부분으로 압축했습니다[20]. (2비트는 각 가중치가 단 4가지 값으로 저장된다는 의미입니다!) 임베딩 레이어는 4비트로, 심지어 주의 캐시도 8비트 값으로 압축됩니다[21]. 그런 다음 저순위 어댑터로 미세 조정하여 손실된 정확성을 회복했습니다[21]. 최종 결과는 매우 적은 메모리를 사용하는 온디바이스 모델입니다 – 표 1은 이것이 얼마나 멀리 가는지를 보여줍니다. Apple은 압축 후에도 품질 차이가 거의 없다고 보고했으며 (일부 벤치마크에서는 심지어 약간 향상되었다고 보고되었습니다)[21]. 이 초소형 모델은 디바이스의 메모리에 상주하며 빠르게 실행될 수 있어 실시간 사용에 필수적입니다.

- Apple Neural Engine (ANE) – Apple의 하드웨어는 여기서 큰 이점을 제공합니다. 최신 아이폰과 아이패드는 16개의 코어를 가진 전용 Neural Engine을 갖추고 있습니다. 예를 들어, A17 Pro 칩의 Neural Engine은 초당 35조의 연산을 수행할 수 있습니다[22]. iOS 19의 기초 모델은 이러한 Neural Engine으로 계산을 오프로드하도록 설계되어 있으며, 이는 저정밀 데이터의 행렬 수학에 뛰어납니다 (바로 양자화된 신경망에 필요한 것입니다). ANE를 활용하여 Apple은 LLM이 높은 처리량과 낮은 전력 소비로 실행되도록 보장합니다. 19.2 베타의 초기 테스트에서는 Apple이 모델의 작업을 더욱 Neural Engine으로 이전하여 엔드 투 엔드 대기 시간을 크게 줄였습니다 (한 보고서에서는 Neural Engine 최적화 후 특정 AI 쿼리에서 40% 속도 향상을 기록했다고 언급했습니다)[23]. 실질적으로 이는 Siri에게 무언가를 물을 때, 서버에 연결하는 지연 없이 디바이스에서 단 몇 초 만에 응답을 생성할 수 있다는 것을 의미합니다.

- 멀티모달 입력 – 온디바이스 모델은 단순히 텍스트를 읽는 것만이 아닙니다. 이미지도 입력으로 처리할 수 있도록 훈련되었습니다. Apple은 모델에 비전 인코더(맞춤형 Vision Transformer)를 추가하여 시각적 데이터를 해석하고 언어와 맞출 수 있도록 했습니다[24]. 예를 들어, iOS Visual Look Up 기능을 사용하거나 카메라로 물체를 가리키며 Siri에게 *“이게 뭐야?”*라고 물어보면, 모델 자체가 이미지 특성을 처리하고 답변을 생성할 수 있습니다. 이 비전+언어 기능은 장면 기억이 시각적 컨텍스트로 확장되는 방법이기도 합니다 – 예를 들어 Siri와 스크린샷을 공유하고 이에 대해 계속 대화할 수 있습니다. 모델을 60억 이미지-텍스트 쌍으로 CLIP 스타일 목표를 통해 멀티모달로 훈련하면 Apple의 AI가 화면이나 사진에 있는 내용을 네이티브로 이해할 수 있게 되어 별도의 클라우드 비전 API가 필요하지 않습니다. 이미지를 통해 의미를 추출하는 작업은 온디바이스에서 이루어집니다.

표 1. Apple의 기본 모델을 위한 압축 기술 (기기 내 vs. 서버)[20][21]

애플은 iPhone과 iPad에서 효율적으로 실행되도록 장치 내 모델을 극적으로 압축(2비트 가중치로)합니다. 반면 클라우드 모델은 규모가 커서 ASTC라는 다른 압축을 사용합니다. 두 모델 모두 품질을 유지하기 위해 세밀하게 조정된 어댑터를 적용합니다.[20][21]

본질적으로, 애플의 온디바이스 LLM은 애플의 칩 성능을 최대한 활용하도록 축소되고 최적화된 두뇌입니다. 순수한 지식에서는 100B 매개변수 클라우드 모델과 맞먹을 수 없지만, 애플은 일반적인 사용자 작업을 빠르고 정확하게 처리하도록 특별히 설계했습니다. 내부 평가에 따르면, 3B 모델은 여러 작업에서 일부 경쟁사의 4B 매개변수 모델과 비교해도 손색이 없었습니다[17]. 애플은 이 로컬 모델이 텍스트 요약, 이해, 재구성, 짧은 대화와 같은 작업에 뛰어나다고 명시하고 있지만, “일반 세계 지식을 위한 챗봇으로 설계된 것은 아닙니다.”[26] 다시 말해, 모든 희귀한 퀴즈 사실을 알지는 못할 수 있지만(그런 경우에는 Siri가 여전히 온라인 검색이나 더 큰 클라우드 모델을 활용할 수 있습니다[27][28]), 여러분의 일상 콘텐츠를 돕는 데 있어서는 - 이메일 작성, 문서 요약, 대화 번역 등 - 매우 잘 조정되어 있습니다. 그리고 결정적으로, 완전히 엣지에서 실행되어, 다음 섹션인 엣지 추론의 이점 및 “장면 메모리”의 역할을 위한 무대를 마련합니다.

「장면 기억」 – Siri의 새로운 맥락 초능력

iOS 19.2에서 가장 눈에 띄는 개선점 중 하나는 Siri(및 기타 지능형 기능)가 이제 맥락을 처리하는 방식입니다. 이제 Siri가 당신이 방금 물어본 것을 2초 만에 잊어버리는 시대는 지났습니다. 애플은 Siri에게 단기 기억력 또는 “장면” 인식을 부여했습니다. 그렇다면 장면 기억이란 정확히 무엇일까요? 이것은 개인적 맥락, 화면 맥락, 그리고 연속적인 대화 기억의 결합으로, 사용자의 요청 주위의 더 넓은 상황을 애플의 AI가 이해할 수 있게 합니다.

- Conversational Continuity: Siri can now keep track of context from one request to the next in a dialogue[6]. This means you can ask, “How tall is the Eiffel Tower?” and follow up with “Could I see it from Montmartre?” – Siri understands “it” refers to the Eiffel Tower because the prior query is still in context. This is a dramatic upgrade from old Siri, which treated each query in isolation. Back-and-forth conversations and follow-up questions are finally possible, making Siri feel much more natural and chatty (closer to Alexa or Google Assistant’s continued conversation mode, and indeed ChatGPT-like behavior). The on-device LLM’s transformer architecture is inherently good at this kind of prompt chaining, and Apple’s implementation stores the recent interaction history locally so Siri can refer back. Of course, this context memory is ephemeral and private – it’s not uploaded, just kept in RAM for the session.

- Personal Context Awareness: iOS 19.2 also gives Siri deeper awareness of data on your device (with your permission). Apple describes this as Siri learning about “your personal context – like your emails, messages, files, photos and more – to assist in tasks”[8]. For example, you could ask, “Siri, what time is my flight tomorrow?” and Siri could look in your Mail app for boarding passes or in your Calendar for events to find the answer, rather than saying “I don’t know” as in the past. It’s essentially building a local knowledge graph about you. Another scenario: you mention “the PDF I was reviewing yesterday” – Siri’s personal context memory can identify which file you likely mean based on your recent activity and open it. This device-local indexing of your content was likely a long-running goal; Apple had spotlight search and Siri suggestions for years, but now the LLM can tap into that trove in a conversational way. All of this stays on-device (nothing is sent to Apple’s servers) so it maintains Apple’s privacy pledge while making Siri notably more useful and personalized.

- On-Screen (Scene) Awareness: Perhaps the most immediately handy aspect of Scene Memory is Siri’s ability to understand what you’re currently looking at or doing on the phone – the active scene. Apple calls this onscreen awareness, and it lets Siri perform “actions involving whatever you’re looking at”[29]. In practice, this might mean: if you have a recipe open in Safari, you could say “Siri, save this to my notes” and Siri knows “this” means the webpage you have open, automatically clipping it. Or if you’re viewing a text thread about an event, you can say “Remind me about this later” and Siri creates a reminder with a link to that conversation. Prior to this, such commands would stump Siri. Under the hood, Apple’s system intelligence APIs can feed context (like the frontmost app, or selected text, or the content of a webpage) into the LLM prompt. iOS 19 even added Intents for “Continue with Current Screen” so apps can expose what’s on screen to Siri securely. The result is a voice assistant that’s situationally aware – almost like it’s looking over your shoulder at your screen (in a helpful way!). This scene awareness was a long-requested feature (other platforms did partial implementations), and now with the combination of the LLM and system integration, Siri might finally “get” what you mean by “convert this to a PDF” or “share this with Alice” without a dozen follow-up questions.

무대 뒤에서 Scene Memory를 활성화하는 것은 소프트웨어와 AI 모두에게 도전이었습니다. Apple은 LLM을 Siri의 전통적인 의도 실행기와 지식 기반과 통합해야 했습니다. 보도에 따르면, Apple은 Siri가 요청을 이행하는 방법을 결정하는 새로운 「쿼리 플래너」 시스템을 가지고 있습니다. 웹 검색, 기기 내 데이터 사용, Siri 단축어/앱 의도를 통한 앱 호출 등으로 요청을 처리합니다[30]. LLM은 복잡하거나 모호한 쿼리를 해석하고 대화 상태를 유지하는 데 도움을 줄 가능성이 높으며, Siri의 기존 시스템은 명령 실행(앱 열기, 메시지 보내기 등)을 처리합니다. Apple은 또한 긴 콘텐츠를 요약하기 위해 「요약자」 모듈을 사용하고 있습니다. 예를 들어 “오늘 이메일에서 놓친 것은 뭐야?”라고 Siri에게 물으면 기기 내 모델이 최신 이메일을 요약해줄 수 있습니다[31]. 이러한 모든 요소들이 함께 작동하여 Siri를 훨씬 더 능동적으로 만듭니다. 실제로 Apple은 Siri가 개인적 맥락 메모리를 활용하여 “앱 내 및 앱 간에 사용자를 위해 조치를 취하는 것”을 목표로 한다고 명시했습니다[32]. 우리는 Siri가 고정된 음성 명령 시스템에서 실제로 맥락을 기억하고 이에 대해 추론할 수 있는 유연한 개인 비서로 천천히 변화하는 과정을 목격하고 있습니다.

이 기능들이 여러 번 지연되었다는 점에 주목할 가치가 있습니다. 애플은 원래 iOS 18에 이 기능들을 계획했으나, 19로 미루었고, 그조차 .0 릴리즈에는 모두 포함되지 않았습니다[33][34]. 이제 iOS 19.2에서는 개인 컨텍스트, 화면 인식, 깊은 앱 통합이 드디어 실현되고 있는 것으로 보입니다[35]. 엄청난 소비자 관심은 사람들이 갑자기 시리가 이전에는 할 수 없었던 일들을 해내는 것을 보게 되어 발생합니다. 이 어시스턴트는 더 살아있는 느낌입니다. 초기 사용자 보고서에는 시리가 작업을 연속적으로 수행할 수 있다고 언급합니다 (예: 앨범을 보면서 "이 사진들을 엄마에게 이메일로 보내줘"라고 하면, 한 사용자는 시리가 실제로 한 번에 처리하여 "이 사진들"이 열린 앨범을 의미한다는 것을 인식했다고 말했습니다). 이는 바로 장면 기억의 약속입니다: 덜 번거로운 명령, 더 유연한 이해. 이는 iPhone 사용자에게 이제까지 클라우드 서비스, 예를 들어 ChatGPT 같은 것이 필요했던 AI 도우미 경험을 더 가깝게 가져다 줍니다. 그리고 다시, 애플의 차별점은 오프라인으로 이를 수행한다는 점입니다. 기기가 화면 콘텐츠를 분석을 위해 클라우드에 스트리밍하지 않고, LLM이 지역적으로 컨텍스트를 해석합니다. 프라이버시는 설계상 보호됩니다[36][37], 그래서 이러한 개인화된 기능들을 빅 브라더에 의해 감시받는 듯한 기분 없이 신뢰할 수 있습니다.

씬 메모리를 요약하자면: 애플의 정제된 AI 두뇌와 풍부한 지역 맥락 데이터를 효과적으로 결합하는 것입니다. 이 조합은 훨씬 더 강력한 상호작용을 가능하게 합니다. Siri가 마침내 “누구/무엇/어디에 대해 이야기하고 있는지”를 배우고 유용하게 응답할 수 있게 됩니다. 기술에 익숙한 사용자에게는 수동으로 명확히 하거나 앱 간에 복사-붙여넣기를 해야 하는 시간이 줄어든다는 의미입니다 – 어시스턴트가 알아서 처리합니다. 아직 초기 단계이지만 (Siri가 완벽하지 않고 가끔 맥락을 잘못 이해하거나 명확성을 요구할 때도 있지만), 이는 분명한 발전입니다. 애플이 다음 iOS에서 훨씬 더 큰 AI를 계획하고 있는 가운데 (iOS 20에서 GPT 유사 Siri가 완전하게 등장할 것으로 소문[38]), 19.2의 씬 메모리는 그 방향으로 가는 기초적인 단계입니다.

엣지 추론: 왜 온-디바이스 AI가 중요한가

애플 인텔리전스 2.0의 핵심 주제 중 하나는 엣지 추론 – 중앙 집중형 클라우드가 아닌 사용자의 디바이스(네트워크의 “엣지”)에서 AI를 실행하는 것입니다. 기술적 수단에 대해 언급했지만, 왜 이것이 중요한지 설명해 보겠습니다:

- 개인정보 보호 및 보안: LLM을 기기 내에서 유지하면 데이터가 처리 목적으로 휴대폰을 떠나지 않습니다. 애플이 말하듯이, 개인 대화와 콘텐츠는 개인적으로 유지됩니다[39]. Writing Tools로 이메일을 초안하거나 Siri에게 일정을 물어보세요 – 이러한 정보는 업로드되지 않습니다. 이는 음성 및 컨텍스트를 서버에 보내는 클라우드 어시스턴트와는 큰 차이를 보입니다. Siri가 클라우드 도움을 사용할 때조차(일부 쿼리에 대한 ChatGPT 통합과 같은 경우) Private Cloud Compute를 통해 데이터를 암호화하고 제3자가 보유하지 않도록 라우팅합니다[40][27]. 하지만 19.2의 대부분의 작업은 기기에서 로컬로 처리할 수 있습니다. 이는 E2E 암호화와 개인 정보 보호를 중시하는 사람들의 요구를 만족시키고, 애플의 브랜드 철학과 일치합니다. 보안 면에서 기기 내 추론은 네트워크 공격이나 유출에 노출될 가능성을 줄이며, AI 요청이 인터넷을 통해 전송되지 않아 가로채지지 않습니다.

- 오프라인 사용 가능성: 엣지 AI는 인터넷 없이 작동합니다. 이는 여행 중 데이터가 없을 때 언어 번역이 필요하거나, 외딴 지역에서 Siri를 통해 메모에서 정보를 불러올 때 큰 도움이 됩니다. iOS 19의 오프라인 LLM을 통해 많은 기능이 계속 작동합니다. 예를 들어, 라이브 번역은 메시지나 통화에서 텍스트를 번역할 수 있으며, 신호가 전혀 없어도 가능[14]합니다. 번역 모델이 기기 내에 있기 때문입니다. 애플의 디자인은 핵심 지능 기능을 위한 *“오프라인 우선”*으로 설계되었습니다. 자주 사용하는 AI 루틴과 최근 컨텍스트를 기기 내에 캐시하여 오프라인으로 전환 시 최소한의 혼란을 야기합니다[41][42]. 이는 더욱 포괄적입니다 – 모든 사람이 항상 고속 인터넷을 사용하는 것은 아니며, 심지어 발전된 지역에서도 우리는 데드존을 만날 수 있습니다. 오프라인일 때마다 끊기는 개인 AI는 그다지 “개인적인” 것이 아닙니다. 애플은 이를 인식하고, Macaron(곧 논의할 개인 AI 에이전트)도 같은 철학을 채택합니다: 언제 어디서나 당신과 함께하는 AI[43].

- 저지연 및 실시간 상호작용: 기기 내에서 추론이 이루어질 때, 서버로의 왕복 지연이 사라집니다. 작업이 더욱 빠르게 느껴집니다. 예를 들어, Safari나 Mail에서 요약하기 기능은 거의 즉시 요약을 생성할 수 있으며, 클라우드 API는 몇 초가 걸릴 수 있으며 네트워크 지연이 추가됩니다. 애플의 Neural Engine 가속화는 응답이 거의 실시간으로 이루어지도록 보장합니다. 주요 포인트 중 하나는 19.2에서 Siri 쿼리의 응답 시간을 Neural Engine으로 작업을 오프로드하여 줄였다는 점입니다[23]. 사용자 경험 측면에서, 이러한 저지연은 AI가 더 반응적이고 상호작용적으로 느껴지게 하여 사람들을 사용에 더 많이 유도합니다. Siri와의 대화는 거의 방안에 있는 사람과 대화하는 것처럼 빠릅니다. 마찬가지로, 키보드의 예측 텍스트(이제 LLM에 의해 강화된)는 최소한의 지연으로 작동할 수 있으며, 로컬로 계산되기 때문에 전체 문장 제안을 즉시 생성할 수 있습니다. 기기 내에서 추론을 수행함으로써, 애플은 서버 비용과 때때로 클라우드 AI 서비스를 제한하는 요금 제한을 우회합니다 – 바쁜 서버 대기열이 없고, 당신의 휴대폰은 당신에게 전념합니다.

- 비용 및 지속 가능성: 수백만 명의 사용자를 위한 클라우드에서 대규모 AI 모델을 실행하는 것은 매우 비싸고(GPU 서버 비용 측면에서) 에너지를 많이 소모할 수 있습니다. 추론을 엣지 디바이스로 옮김으로써 애플은 계산을 이미 사용자의 손에 있는 하드웨어로 옮깁니다(효율성을 위해 목적에 맞게 제작됨). 애플은 기기 내 모델을 사용하는 개발자가 사용료가 없다[3]고 강조하기도 했습니다 – 외부 AI 서비스에 대한 API 호출당 비용을 지불하는 것에 비해 큰 인센티브입니다. 지속 가능성 측면에서, AI를 분산화하면 많은 전력을 소비하는 데이터 센터의 부하를 줄일 수 있습니다. 각 iPhone이 작은 양의 AI 작업을 수행하는 것이 중앙 서버 팜에 수십만 개의 요청이 몰리는 것보다 더 에너지 효율적일 수 있습니다(특히 애플의 Neural Engine이 와트당 높은 성능으로 최적화되어 있기 때문입니다). 장기적으로, 광범위한 엣지 AI는 일부 클라우드 컴퓨팅 병목현상과 비용을 완화할 수 있습니다.

그럼에도 불구하고, 애플의 접근 방식에는 타협점이 있습니다. 기기 내 모델은 크기가 작아 GPT-4 같은 것만큼 일반적인 지식이 풍부하지는 않습니다. 애플은 이것이 모든 질문에 대한 광범위한 챗봇을 대체하기 위한 것이 아님을 인정합니다. 그래서 애플은 시리가 세계를 이해하는 능력을 향상시키기 위해, 심지어는 구글의 1.2조 매개변수 Gemini 모델을 사용하여 대규모 모델을 계속 사용할 계획입니다. 하지만 iOS 19.2에서 보여준 것은 개인 비서 작업의 큰 범주에 대해 잘 설계된 30억 매개변수 모델이 충분하다는 것입니다 – 그리고 이를 로컬에서 실행하는 이점은 엄청납니다. 이것은 전략적 베팅입니다: 개인적이고 맥락적인 작업을 기기 내에서 처리하고, 클라우드에는 오직 무거운 작업만을 위해 남겨 두는 것입니다 (Private Compute 같은 프라이버시 래퍼와 함께). 이 하이브리드 엣지-클라우드 모델은 표준이 될 수도 있습니다.

이 전략을 실천하는 예로, 사용자별 작업과 오프라인 기능에 집중하는 개인 AI 에이전트인 Macaron을 살펴보겠습니다. Apple의 기기 내 AI 발전은 Macaron과 같은 도구가 하는 일과 실제로 잘 맞아떨어집니다.

Macaron 미니 앱과 저지연 개인 에이전트의 미래

Macaron은 사용자가 대화를 통해 '미니 앱'을 만들 수 있게 하는 개인 AI 어시스턴트 플랫폼입니다. 이는 본질적으로 일상적인 필요에 맞춘 맞춤형 AI 워크플로우입니다. iOS의 내장 지능이 모든 사용자에게 제공되는 Apple의 광범위한 솔루션이라면, Macaron은 더욱 개인화되고 사용자 중심의 접근 방식을 취합니다. 당신이 필요를 말하면, 그에 맞는 솔루션을 즉석에서 만들어줍니다. 그렇다면 Apple의 오프라인 LLM과 Scene Memory는 어떻게 여기에 맞아떨어질까요? 한 마디로: 완벽하게.

Macaron의 철학은 오프라인 우선, 저지연, 사용자 중심 디자인을 강조합니다. Macaron 팀에 따르면 진정한 개인 AI는 언제 어디서나, 심지어 연결 상태가 좋지 않을 때도 작동해야 하며, 사용자에게 적응해야 합니다[43][42]. 이는 Apple의 기기 내 AI 업그레이드의 강점과 정확히 일치합니다. iOS 19.2의 기초 모델을 통해 Macaron은 항상 클라우드 API에 의존하지 않고 Apple의 기기 내 지능을 활용할 수 있습니다. 예를 들어:

- 즉석 미니 앱 생성: Macaron을 사용하면 사용자들이 *“식단 계획 앱을 만들어 주세요”*와 같은 요청을 할 수 있으며, 이를 통해 생성형 AI가 해당 목적에 맞는 미니 앱을 조립합니다[45][46]. 이 생성 단계가 기기에서 실행될 수 있다면(Apple의 모델을 새로운 Foundation Models SDK를 통해 사용), 실시간으로 생성되며 서버 지연이 없습니다. 사용자는 몇 초 만에 작동하는 미니 앱을 얻을 수 있습니다. 이는 또한 개인 선호도나 데이터를 포함하는 지시 사항이 생성 중 기기에서 유지된다는 것을 의미합니다[3].

- 미니 앱의 맥락 이해: Macaron의 미니 앱은 종종 개인 데이터를 포함합니다 – 예를 들어 습관 추적기나 개인 재무 분석기 – 그리고 이들은 맥락 인식을 통해 이점을 얻습니다. 이제 Scene Memory 기능이 가능해지면서, Macaron은 시스템 인텔리전스로부터 화면 내 맥락이나 개인 맥락을 요청하여 미니 앱 워크플로에 통합할 수 있습니다. 예를 들어, 이메일 관리용 Macaron 미니 앱이 있다면, Siri의 새로운 이메일 요약 기능이나 중요한 이메일 식별 기능을 활용할 수 있습니다 (Apple이 iOS 19의 인텔리전스 스위트에서 공개한 기능)[47][48]. Macaron은 기본적으로 Apple의 OS 수준 AI 서비스를 통해 더 스마트한 캔버스를 얻게 됩니다.

- 저지연 에이전트 UX: Macaron의 장점 중 하나는 매끄럽고 대화형 사용자 경험입니다 – AI 에이전트가 파트너처럼 협업합니다. Apple의 엣지 AI는 응답과 작업이 최소한의 지연으로 이루어지도록 보장하여 자연스러운 흐름을 유지하는 데 중요합니다. Macaron 미니 앱은 이제 기기에서 즉시 언어 번역, 이미지 인식 또는 텍스트 분석과 같은 작업을 수행할 수 있으며, 이전에는 클라우드 API를 호출하고 기다려야 했을 수도 있었습니다. Macaron 플레이북은 예를 들어 요리 레시피를 안내할 때 기기 내 비전을 사용하여 실시간으로 재료를 인식하거나, LLM을 사용하여 인터넷 검색 없이 “버터 대체재는 무엇인가요?”라는 질문에 답변할 수 있습니다. 이로 인해 더 몰입적이고 신뢰할 수 있는 에이전트 경험이 창출됩니다.

- 개인 AI의 향상된 프라이버시: Macaron은 개인 에이전트로서 사용자 정보(일정, 메모, 건강 데이터 등)를 처리합니다. Apple의 기기 내 처리와 일치하여, Macaron은 AI 작업 중 정보가 기기를 벗어나지 않는다는 점에서 사용자를 안심시킬 수 있습니다. 실상 Macaron은 저대역폭 또는 오프라인 사용 모드를 명시적으로 제공하여 중요한 데이터를 로컬에 캐싱하고 필요할 때 작은 대체 모델을 사용할 수 있습니다[49][42]. Apple의 19.2 LLM은 그 오프라인 모델로서 기능할 수 있으며, 클라우드 AI에 접근할 수 없을 때 기본 요청을 처리할 수 있는 유능한 대체 모델입니다[42]. 여기에서의 시너지는 Apple과 Macaron이 **“기기에서 사용자에게 작동하는 AI”**를 목표로 수렴하고 있다는 점이며, 이는 사용자 신뢰와 자율성을 높입니다.

- 워크플로우의 맥락 유지: Macaron의 미니 앱은 흔히 여러 단계의 프로세스입니다 (Macaron은 이를 플레이북 또는 마이크로 플로우라고 부릅니다[50]). Scene Memory 개념은 이러한 단계 간 상태를 유지하는 데 도움을 줄 수 있습니다. 여행 계획 미니 앱이 있다고 가정해 봅시다: 1단계에서는 항공편을 찾고, 2단계에서는 호텔을, 3단계에서는 일정을 만듭니다. 맥락 메모리를 통해 AI는 모든 것을 다시 요청하지 않고도 한 단계에서 다음 단계로 정보를 가져갈 수 있습니다. Macaron은 이미 흐름을 논리적인 조각으로 구조화하여 인지 부하를 줄이고 있으며[51], 이제 AI 백엔드는 이미 수행된 작업과 다음에 할 작업을 더 잘 추적할 수 있습니다. 또한 “사실, 하루 늦게 해주세요”와 같은 후속 변경 사항도 현재 계획을 이해하여 처리할 수 있습니다.

전반적으로, Apple의 엣지 AI 업그레이드는 iOS 위에 존재하는 Macaron과 같은 플랫폼을 강화합니다. 우리는 개인 AI 에이전트가 클라우드에 고립되지 않고 우리의 개인 기기에서 살아가는 생태계로 나아가고 있습니다. 시스템 지능과 조화롭게 작동하는 것입니다. Macaron의 손끝의 미니 앱 비전은 기본 OS가 AI 작업을 더 유연하게 실행할 수 있기 때문에 더욱 강화됩니다. Macaron의 디자인 원칙(예: 적응형 콘텐츠, 깊은 개인화, 강력한 오프라인 모드[52][43])이 iOS 19.2에서 Apple이 제공한 것과 얼마나 잘 맞아떨어지는지는 주목할 만합니다. 한때 미래지향적으로 보였던 저지연, 상황 인식 에이전트 UX가 빠르게 현실이 되고 있습니다.

결론: 개인화되고 기기에 탑재된 AI의 새로운 시대

Apple의 iOS 19.2는 소비자 AI 진화의 중요한 순간을 나타냅니다. 힘이 명확하게 엣지로 이동하는 시점입니다. 로컬에서 실행되는 정밀 조정된 LLM을 배포하고, 문맥을 위한 “장면 메모리”를 도입함으로써 Apple은 iPhone의 기능을 변혁시켰습니다. 이것은 단지 Siri를 덜 멍청하게 만드는 것에 그치지 않습니다 (비록 그 결과는 환영할 만하지만); AI 기능에서의 개인 정보 보호와 반응성에 대한 사용자 기대를 재정의하는 것입니다. 이제 당신은 전화기와 준대화할 수 있으며, 콘텐츠와 관련된 즉각적인 AI 도움을 받을 수 있고, 당신의 데이터가 멀리 떨어진 서버 팜으로 비밀리에 전달되지 않는다는 것을 신뢰할 수 있습니다[39][36]. 데이터 개인정보 보호에 대한 우려가 커지는 시대에, Apple의 오프라인 우선 접근 방식은 “우리가 고급 AI 와 개인정보 보호를 가질 수 있을까?”라는 질문에 대한 설득력 있는 답을 제공합니다 – 분명히, 우리는 가능합니다.

기술적으로 Apple Intelligence 2.0은 모델 압축, 하드웨어-소프트웨어 공동 설계, 소비자 운영체제 통합의 걸작입니다. 이것은 증류, 양자화 및 최적화를 통해 수십억 개의 매개변수를 가진 모델이 배터리로 구동되는 장치에서 원활하게 실행될 수 있음을 보여줍니다[18][20]. 이는 더 많은 혁신의 문을 엽니다: 우리는 곧 더 스마트한 음성 입력을 위한 온디바이스 음성 모델이나 클라우드 학습 없이 사용자의 취향을 배우는 로컬 추천 모델을 볼 수 있을 것입니다. 애플은 또한 개발자들이 Foundation Models 프레임워크를 통해 이 물결을 타도록 지원했습니다[10][11] – 온디바이스 LLM을 활용하여 창의적이고 실용적인 목적으로 새로운 앱이 탄생할 것으로 기대하세요. 모든 것이 사용자에게 추가 비용이나 지연 없이 제공됩니다.

기술에 능통한 사용자에게 19.2 업데이트는 특히 만족스럽습니다. 소프트웨어로 하드웨어 업그레이드를 받는 것과 같아서, 기존 장치가 예상치 못했던 새로운 기능을 수행할 수 있게 됩니다. 고급 사용자는 Siri의 컨텍스트 한계를 테스트하거나, 기기 내 모델을 사용하는 복잡한 바로가기를 생성하거나, Macaron 같은 앱을 실행하여 개인 AI의 한계를 넘는 것을 즐길 것입니다. 엣지 AI가 접근성을 어떻게 강화할 수 있는지도 확인 중입니다: 실시간 자막, 텍스트 단순화, 이미지 설명과 같은 기능은 기기에서 수행될 때 더 즉각적이고 신뢰성이 높아져, 장애가 있거나 연결이 제한된 사용자에게 이익을 줍니다[53][54].

물론 Apple만이 엣지 AI 트렌드에 참여하는 것은 아닙니다. Qualcomm, Google 등도 기기 내 AI 가속화를 위해 노력하고 있지만, Apple은 맞춤형 실리콘, 운영 체제, 고급 기능의 긴밀한 통합을 통해 수백만 명의 사용자에게 세련된 제품을 대규모로 제공하는 데 앞서 있습니다. iOS 19.2의 AI에 대한 '큰 소비자 관심'은 사람들이 능력과 신뢰를 모두 중요하게 생각한다는 증거입니다. Apple은 효과적으로 이렇게 말하고 있습니다: 둘 중 하나를 선택할 필요가 없습니다. 당신의 iPhone은 스마트하면서도 당신의 것일 수 있습니다.

앞으로 Apple Intelligence 3.0은 더욱 많은 '장면 기억'을 가질 수 있을 것입니다. 아마도 시간이 지남에 따라 축적되는 지속적인 개인화(역시 로컬에 저장됨) 또는 텍스트, 음성, 비전 및 행동을 매끄럽게 처리하는 완전한 통합 다중 모드 어시스턴트가 가능할 것입니다. 기반은 이미 마련되어 있습니다. Macaron과 같은 개인 AI 에이전트는 이러한 환경에서 번성할 것이며, 각 사용자는 자신을 깊이 이해하면서도 프라이버시를 보호하는 독특한 AI를 가질 수 있습니다.

요약하자면, iOS 19.2에서 애플의 오프라인 LLM과 장면 기억은 기술적 이정표이자 윤리적 입장을 하나로 묶은 것입니다. 이는 AI 발전이 사용자 프라이버시와 경험에 대한 존중과 결합될 때 가능한 것을 보여줍니다. 사용자에게는 더 스마트하고 도움이 되는 기기를 의미합니다. 개발자에게는 기기 내 AI 가능성의 새로운 놀이터가 됩니다. 그리고 업계에는 기준을 높입니다: AI의 미래는 단지 클라우드에 있는 것이 아닙니다. 바로 우리의 주머니에 있습니다. 기기 내 AI의 시대에 오신 것을 환영합니다 - 여러분의 휴대폰 자체가 지능형 에이전트가 되어 날로 더 똑똑해지고 있습니다[7][10].

출처: 이 기사의 정보는 애플의 공식 발표와 기술 보고서, 독립적인 분석에 의해 뒷받침됩니다. 주요 참조 자료로는 애플의 WWDC 2025에서 발표된 기기 내 모델과 개발자 프레임워크에 관한 뉴스[55][10], 애플 머신러닝 연구소의 기반 모델에 관한 기술 보고서(3B 모델 설계, 증류, 양자화 세부 설명 포함)[15][20], 그리고 Siri의 새로운 컨텍스트 기능과 지연된 출시 관련 신뢰할 수 있는 보고서[35][28]. 이러한 출처와 더불어 검증 및 심층적인 읽기를 위한 자료들이 인용되어 있습니다. 개발 내용은 2025년 후반 기준으로 최신화되어 있으며, 기기 내 AI 배포의 최첨단을 나타냅니다.

[1] [2] [3] [5] [6] [7] [10] [11] [12] [14] [39] [47] [48] [55] Apple Intelligence가 Apple 기기 전반에 걸쳐 새로운 기능과 함께 더욱 강력해집니다 - Apple (CA)

[4] Apple Intelligence - Apple

https://www.apple.com/apple-intelligence/

[8] [9] [29] [32] [33] [34] [35] 애플, 사용자가 iOS 19 또는 2026년까지 기존 Siri를 참아야 한다고 발표 – MacTrast

[13] [15] [16] [17] [18] [19] [20] [21] [24] [25] [26] [36] [37] Apple의 온디바이스 및 서버 기초 언어 모델 업데이트 - Apple 머신 러닝 연구

https://machinelearning.apple.com/research/apple-foundation-models-2025-updates

[22] Apple A17 - 위키백과

https://en.wikipedia.org/wiki/Apple_A17

[23] 주요 AI 및 기술 개발 (2025년 11월 1-2일)

https://www.jasonwade.com/key-ai-tech-developments-november-1-2-2025

[27] [28] [30] [31] [40] [44] 애플, 시리를 위한 구글의 1.2조 매개변수, 고비용 AI 모델을 지원으로 사용할 예정

[38] iOS 19에서 개발자는 Apple의 AI 모델을 앱에 사용할 수 있습니다 - MacRumors

https://www.macrumors.com/2025/05/20/ios-19-apple-ai-models-developers/

[41] [42] [43] [49] [50] [51] [52] [53] [54] Macaron의 AI가 모든 사용자에게 적응하는 방법 - Macaron

https://macaron.im/blog/macaron-ai-adaptive-accessibility-features