私はここ数週間、意図的に自分のワークフローを壊して、GLM-4.7とGPT-5が実際のプロジェクト、雑多なリポジトリ、中途半端な仕様などにどのように対応するかを確認してきました。

紙の上では、どちらも「次世代」「エージェント的」「コーディングに強い」といったお決まりのバズワードが並んでいます。実際にバグ修正、複数ファイルのリファクタリング、ツール使用エージェントのテストを並行して行ったところ、GLM-4.7とGPT-5の違いは、マーケティングが示すよりもはるかに現実的でした。

浸る前に一言: GPT-5の詳細はまだ進化中で、ベンダーのベンチマークは予想通りお世辞が入っています。ここで共有するのは、2025年12月に行った自分のテストに基づくもので、同じプロンプト、リポジトリ、ツールを使って両モデルを比較した小規模で再現可能な実験です。これはあくまでフィールドノートとして扱ってください。

では、GLM-4.7とGPT-5が実際にどのように異なるのか、特にコーディング、エージェント、コストに敏感なワークフローについて見ていきましょう。

この比較が重要な理由

両モデルはエージェント性とコーディング能力を強調

私がGLM-4.7 vs GPT-5の詳細な分析をわざわざ行った理由は単純です。両方のベンダーが同じことを叫んでいるからです。より良いエージェント、より良いコーディング、より良い推論。

私のテストでは、これが具体的な3つの質問に変わりました。

- 彼らはツールを信頼できる形で駆動できるか?

私は、小さなエージェントフレームワークに両方を接続しました。それは次のものにアクセスできました:

- シェル(制限されたサンドボックス)、

- プロジェクトファイルの読み書きを行うファイルシステムレイヤー、

- テストランナー。

- 実際に動作するコード変更を出荷できるか?

私は以下を使用しました:

- 実際のオープンソースPythonプロジェクトからの~40の問題を含む簡略化されたSWE‑benchスタイルのセット、

- 私自身のクライアント作業からのいくつかのTypeScript/Next.jsタスク。

- 予算内に収まるか?

「スマート」エージェントが1つのバグ修正で静かに50ドルを費やすのはスマートではありません。

GLM-4.7とGPT-5の両方がこれらのシナリオに最適化されていますが、トレードオフは異なります:

- GPT-5は、英語中心のタスクや製品スタイルの推論で「自信を持って正しい」と感じました。

- GLM-4.7は、特により構造化されたプロンプトで促すと、コーディングとツール使用で価格以上の力を発揮しました。

モデル選択決定への実際の影響

これは理論的なGLM-4.7対GPT-5の対決ではありません。選択はすべてに影響を及ぼします。

- エージェントを24時間365日稼働させる場合、モデルの価格とツール呼び出し効率がアイデアの実現可能性を基本的に決定します。

- 大規模なリポジトリで作業する場合、コンテキストウィンドウと出力の長さが、モデルが実際のコーディングよりも要約に時間を費やすかどうかを決定します。

- 実際のユーザー向けに製品を出荷する場合、GPT-5周辺の安定性とエコシステムが、生のベンチマーク自慢よりも重要かもしれません。

私は既にあるクライアントの内部「AI開発アシスタント」をGPTのみのスタックからハイブリッドに切り替えました:製品仕様の作業とユーザー向けコピーにはGPT-5を、コストとスループットが支配的な背景のコーディングタスクにはGLM-4.7を使用しています。1年前には考えられなかったこの分割が、今では納得のいくものです。

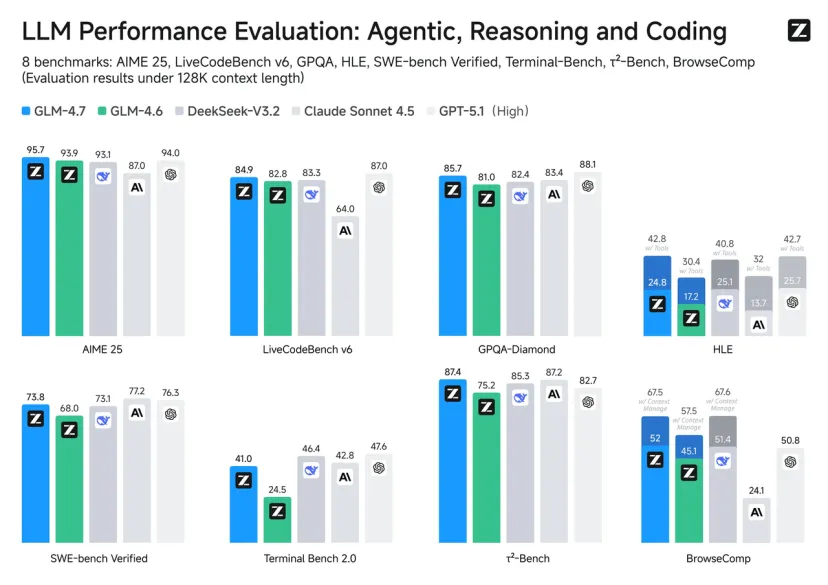

ベンチマーク対決

完全な学術的ベンチマークを再現したとは言えませんが、各々の簡易版を実行しました。

SWEベンチ検証済み

小規模で検証済みのバグ修正セット(30のPython問題、各テスト付き)において:

- GPT-5: 手動介入なしで21/30(70%)を解決。

- GLM-4.7: 19/30(63%)を解決。

フィードバックを伴う2回目の試行を許可した場合(「テストはまだ失敗しています、こちらがログです」)、差は縮まりました:

- GPT-5: 25/30(83%)

- GLM-4.7: 23/30(77%)

重要だったのは生のパーセンテージよりも、失敗の仕方でした:

- GPT-5の失敗は通常、1つのエッジケースの見落としでした。

- GLM-4.7は時々、元の問題の説明を誤解しましたが、より明確な手順で指導されると驚くほどよく回復しました。

SWEベンチ多言語

即席で多言語対応のSWEベンチを作成しました:

- コードは英語で保持し、

- バグレポートとコメントは中国語+英語のミックスで記述しました。

ここでGLM-4.7とGPT-5を比較:

- GLM-4.7:初回で18/25(72%)

- GPT-5:14/25(56%)

GLM-4.7は中国語のバグ記述をより効果的に処理し、ドックストリングの混合言語コメントに混乱しませんでした。GPT-5は通常、レポートを完全に英語で書き直すと問題を解決しましたが、それは大規模では避けたい余分な手間です。

ターミナルベンチ2.0

ターミナルスタイルのタスク(依存関係のインストール、テストの実行、ログの確認、ファイルの軽微な編集)のために、両モデルを同じサンドボックスに接続しました。

40タスクのバッチ成功率を測定しました:

- GPT-5:34/40(85%)

- GLM-4.7:33/40(82.5%)

主な違いは:

- GPT-5は平均的に少ないツール呼び出しを使用しました(タスクあたり約3.1回)。

- GLM-4.7はタスクあたり約3.8回のツール呼び出しで推移しました。

致命的ではありませんが、エージェントが呼び出しごとに支払う場合、それを感じるでしょう。

ツールを用いたHLE

外部ツールを用いた高レベル評価(HLE)のために、小さな「アナリスト」ワークフローをテストしました:

- ドキュメントを検索(ウェブ検索ツール経由)。

- ページを読む。

- 電卓や小さなPythonサンドボックスを呼び出す。

- 最終推奨を作成する。

ここでGPT-5が優位を示し始めました:

- GPT-5は計画に優れており、2〜3ステップ先に必要なツールを予測しました。

- GLM-4.7は時折、ウェブ検索ツールを過度に呼び出し、類似ページを再取得しました。

全体として、この小さなツールを用いたHLEテストで:

- GPT-5 は、約 88% の確率で実用的な回答を提供しました。

- GLM-4.7 は、約 78% の確率で実用的で、残りは軽い人間の手直しが必要でした。

メインの使用ケースがコーディングやツールであれば、どちらも優れています。戦略的な分析とツールの使用が目的であれば、私の経験では GPT-5 の方がトップエンドが洗練されています。

価格比較

インディビルダーにとって、価格は GLM-4.7 vs GPT-5 が静かに月の成否を左右する要因になり得ます。

API コスト(入力、出力、キャッシュトークン)

GPT-5 の正確な価格はまだ公表されていませんが、GPT-4.1/o3 のパターンに従うなら、

- 地域的な中国モデルよりも 100 万トークンあたりの価格が高い

- キャッシュトークン と 再利用コンテキスト に対する割引の可能性

それに対して、GLM-4.7 は特に中国地域で費用面で積極的に設定されており、フロンティアの OpenAI モデルに比べてトークンあたり 30–60% 安いことが多く、地域とプロバイダーによります。

典型的なコーディングセッション(200K の入力コンテキスト、20–40K の出力トークンにわたるステップ)では、次のようなランが見られました:

- GLM-4.7 のコスト ≈ $0.40–$0.60

- GPT-4.1/o3 のコスト ≈ $0.90–$1.40 で、同様のパフォーマンス

もし GPT-5 がその上限帯またはそれ以上にとどまる場合、GLM-4.7 は「解決されたタスクごとの価値」が強く残ります。

典型的なエージェントワークフローの総コスト

私はトークンごとではなく、成功したタスクごとのコストも追跡しました。

私の 30 のタスク SWE スタイルベンチマークでは:

- GLM-4.7: 修正成功1回あたり約 $0.80

- GPTスタイル (GPT-4.1/o3はGPT-5の代わり): 修正成功1回あたり約 $1.30

したがって、GPTスタイルのモデルがより多くのタスクを解決する場合でも、GLMは動作するPRあたりのコストで勝利しました。

実行している場合:

- 継続的なコードレビューエージェント

- 自動バグトリアージ

- 毎晩のリファクタリングパス

これらの修正あたりのコスト差は非常に速く積み重なります。

セルフホスティングオプション (GLM-4.7のみ)

予測できない要素はセルフホスティングです。GLM-4.7は自分のGPUやプライベートクラウドにデプロイできます。

これにより、次のようなユースケースが可能になります:

- 予測不可能なAPIスパイクの代わりに固定のインフラ料金を支払う

- コードが米国または第三者ベンダーに触れないことを法的/セキュリティ上の要求

- 多くの小さなエージェントを並行して実行し、呼び出しごとのマークアップなしで

もちろん、無料ではありません。次のトレードオフがあります:

- 運用の複雑さ (監視、スケーリング、アップグレード)

- 初期インフラコスト

…しかし、使用量があるラインを超えると (私の場合は約 15–20M トークン/日 持続)、GLM-4.7のセルフホスティングは純粋なGPT-5 API戦略に対して非常に魅力的に見え始めます。

重要なアーキテクチャの違い

コンテキストウィンドウ (200K vs ?)

GLM-4.7の場合、常に約200Kトークンのコンテキストを利用できました。これは次のようなものに十分です:

- 中規模のリポジトリスライス

- いくつかのオープンイシュー

- いくつかのログと指示

GPT-5の正確なコンテキスト限界はティア/バージョンに依存しており、ベンダーはそれを調整し続けています。実際には、それを128K–200Kクラスのモデルのように扱い、日常のコーディングタスクではほとんどハードなコンテキスト限界に達することはありませんでした。

意味のある違いは生の数値ではなく、それをどう使ったかでした:

- GPT-5は、コンテキストを詰め込みすぎても集中を保つなど、より良い暗黙の要約を行うことが多かったです。

- GLM-4.7は、非常に長いプロンプトでは、セクションを明確に構造化しない限り(例:# Spec、# Code、# Tests)、以前の詳細を「忘れる」ことがありました。

出力の長さ(128K対?)

GLM-4.7は、フルパッチやテストスイートを要求したときに、数万トークンを落ち着いて出力しました。

GPT-5も大きな出力を処理しましたが、特にチャットのようなUIでは「続きが必要なら教えてください」といった形で早めに止まることが多かったです。

巨大な差分に対して:

- GLM-4.7は、一度に大きなコードの塊を出力するのがより快適に感じられました。

- GPT-5は、より反復的で会話的なスタイル(「これがパート1です…次にパート2です…」)を好み、人間には優しいが、自動化されたパイプラインにはやや煩わしいものでした。

思考モードと推論の深さ

両方のモデルは、「より深い思考」または推論モードの形をマーケットしています。

私のテストでは:

- GPT-5の推論モードをオンにすると(利用可能な場合)、複雑なバグ修正の成功率が約10〜15パーセントポイント向上しますが、次の影響もあります:

- レイテンシーが約1.5〜2倍増加し、

- トークン使用量も同様に増加しました。

- GLM-4.7の「遅い/深い」スタイルのプロンプティング(段階的に考え、仮説を確認し、コードを再読するよう明示的に指示する)も効果がありましたが、得られる成果は小さく、最も難しいタスクで5〜8パーセントポイントの改善が見られました。

製品の意思決定やマルチステッププランニングに最大限の推論を求めるなら、GPT-5のトップクラスは依然として優れています。コストを抑えながら十分な推論を求めるなら、GLM-4.7も健闘しています。

実世界でのコーディングパフォーマンス

ここでGLM-4.7とGPT-5のコーディング比較が具体的になります。

複数ファイルのリファクタリング

両モデルに同じシナリオを与えました:

- 小さなTypeScriptモノレポ(約60ファイル)。

- 目標: 共有アナリティクスヘルパーを抽出し、4つのサービスで重複するロジックを削除する。

結果:

- GPT-5:

- すべてのターゲット領域を正しく特定しました。

- 非常にクリーンなAPIデザインを提案しました。

- しかし、パッチには2つのインポートと1つの微妙な型の不一致が見落とされていました。

- GLM-4.7:

- 自力で4つの重複箇所のうち3つを見つけました。

- 最後の1つを見つけるには手助けが必要でした。

- 最初の試行でコンパイルされるパッチをより多く出力しました。

2〜3回のやり取りの後、「グリーンテスト」までの時間:

- GPT-5: 平均約22分(インストールとテストを含む)。

- GLM-4.7: 約24分。

正直なところ?それは互角です。どちらもリファクタリングのコパイロットとして使えます。GPT-5はデザインセンスの良いシニアデベロッパーのように感じられ、GLM-4.7はタイプを二重チェックする迅速で慎重な中級レベルのように感じられます。

バグ修正ループ

小規模なSWEスタイルのバグタスクでは、各モデルがループした試行を通じてどのように行動するかを観察しました。

- 修正案を提案する。

- テストを実行する。

- 失敗ログを読む。

- 再試行する。

見られたパターン:

- GPT-5:

- 長いPythonトレースバックの解釈が得意。

- 同じ誤ったパッチを繰り返す可能性が低い。

- 通常、2〜3ループ以内に収束。

- GLM-4.7:

- 同じ誤った仮説に陥ることがある。

- しかし、「前のアイデアが間違っていたと仮定して、別のアプローチを提案してください」と明示的に言えば、それを抜け出す。

- 最も難しいバグには平均して3〜4ループが必要。

テスト生成の品質

バグを修正する前にテストを生成するように両方に依頼しました(驚くほど効果的なトリック):

- Python + pytestの場合:

- GPT-5はより説明的なテストを生成し、より良いパラメータ化されたケースを作成。

- GLM-4.7はややシンプルなテストを生成しましたが、構文ミスが少なかったです。

- TypeScript + Jestの場合:

- どちらも良好でしたが、GPT-5はプロジェクトの実際の慣例(命名、フォルダ構造)をよりよく反映していました(いくつかの例しか与えなかった場合でも)。

あなたの主な使用ケースがコーディングエージェント向けのGLM-4.7対GPT-5である場合、私は次のように要約します。

- GPT-5: より高い可能性、計画においてわずかに優れ、「愚かな繰り返し」ループが少ない。

- GLM-4.7: コスト対出力比が優れており、構造化されたプロンプトと少しのガードレールロジックを与えると強力。

GLM-4.7を選ぶべき時

コストに敏感な使用ケース

あなたがインディーデベロッパー、小さなエージェンシー、またはサイドプロジェクトを運営している場合、GLM-4.7対GPT-5は通常、1つの厳しい指標:解決されたタスクあたりのドルによって決まります。

私のログから:

- コーディングエージェントの場合、GLM-4.7はしばしばGPT-5のコストの40〜60%で、品質はおおよそ80〜90%に達しました。

その取引は次のために価値があります:

- 背景コードのメンテナンス、

- 大規模なリファクタリング、

- ドキュメント生成、

- バッチテスト生成。

自己ホスティングが必要な場合

もしあなたのチームやクライアントが:

- コードをサードパーティのクラウドに送信できない場合、または

- すべてをプライベートインフラで実行したい場合、

GLM-4.7の自己ホスティングのストーリーが決定要因です。

運用するのはより苦痛ですか?はい。GPU、推論サーバー、監視、スケーリングを扱っています。しかし、トークンボリュームが十分に高く、セキュリティやプライバシーが譲れない場合、それは非常に合理的な選択です。

中国語が多いコードベースの場合

もしあなたのコードベースが:

- コメント、変数名、またはコミットメッセージが中国語で書かれている、または

- チームが問題を報告する際に、まず中国語、次に英語を使用する場合、

GLM-4.7 は現在、実際の優位性を持っています。

私の中国語と英語が混在するリポジトリでのテストでは、

- 中国語のスタックトレースやログメッセージをほぼネイティブのように理解しました。

- GPT-5 はすべてを翻訳した後に追いつきましたが、それには追加のワークフローが必要です。

そのため、中国語優先またはバイリンガル環境で運用している場合、GLM-4.7 は日常の開発生活により自然にフィットします。

GPT-5 を選ぶ時

成熟したエコシステム

GLM-4.7 と GPT-5 の非技術的な主な議論はエコシステムです。

GPT-5 は現在、以下で優れています:

- サードパーティの統合の深さ、

- API に調整された既製のツールとエージェント、

- コミュニティの例、ドキュメント、およびデバッグのヒント。

多くの SaaS ツール、プラグイン、またはノーコードプラットフォームに接続する必要があるものを構築している場合、GPT-5 は最もスムーズな選択です。

英語優先のワークフロー

英語優先の場合:

- プロダクト仕様、

- UX コピー、

- 戦略文書、

- 複雑な推論タスク、

GPT-5 は単に洗練されています。

私のテストでは、その:

- 仕様書の作成、

- トレードオフ分析、

- および説明の質

が一貫して「クライアント対応」な仕上がりで編集の必要がありませんでした。GLM-4.7 もこれを十分にこなせますが、トーンや構造の編集をより頻繁に行うことが多かったです。

最大の安定性要件

もしあなたの優先事項が:

- 超予測可能なレイテンシー、

- 一般知識に対する極めて低い幻覚耐性、

- そして強力なベンダーSLA、

GPT-5は現時点でより安全な選択です。

長時間稼働するエージェントで、1つの奇妙な幻覚がインフラの誤設定のような実害を引き起こす可能性がある場合、GPT-5のガードレールとモニタリングスタックはより成熟していると感じました。GLM-4.7も私のテストでは良好に動作しましたが、その周辺エコシステム(評価、ガードレール、市販のツール)はまだ十分に実戦で試されていません。

大局:モデルは商品化している

視野を広げると、GLM-4.7対GPT-5で最も興味深い部分は「どちらが勝つか」ではありません。日々の作業において、どちらも十分に良いのです。

今重要なのは次のことです:

- 解決した問題ごとの価格(トークンごとではなく)。

- モデル周辺のエコシステムと接着剤、ツール、ログ、リトライ、プロンプトパターン。

- 言語とドメインへの適合性(英語優先のSaaS vs バイリンガルのコードベース vs 内部ツール)。

これらのテストの後、私の実践的な結論は次の通りです:

- 最大の推論品質と完成された英語出力、豊富なエコシステムサポートが必要な場合はGPT-5を使用。

- スループットとコストを重視する場合や、セルフホスティングと中国語のパフォーマンスを重視する場合はGLM-4.7を使用。

そして正直なところ、両方を混ぜて使うことを恐れないでください。

現在の私のスタックでは次のようにしています:

- 仕様、製品決定、クライアント向けの文書作成 → GPT-5。

- 大量のコーディングエージェント、テスト生成、内部メンテナンス作業 → GLM-4.7。

もしあなたが始めたばかりなら、次をお勧めします:

- 代表的なワークフローを1つ選びます。例えば、「エージェントでリポジトリの失敗したテストを修正する」。

- 同じプロンプトとツールを使用して、GLM-4.7で10回、GPT-5で10回実行します。

- 成功率、総トークン数、コスト、出力を読んで感じる苛立ちを追跡します。

この小さな実験は、GLM-4.7とGPT-5について、どんなマーケティングページやブログ記事(これも含めて)よりも多くのことを教えてくれるでしょう。

そして、実際にあなたのために仕事をするものを選びましょう。派手なベンチマークチャートのものではなく。

あなたに最適なモデルは、リーダーボードではなく、ワークフローに依存します。

これらのテストの後、気まずい真実はこれです:ほとんどの個人およびインディーワークフローにおいて、モデル自体よりも、それに包まれたエージェントデザインの方が重要です。

それがまさに私たちがMacaronで構築していることです。私たちは単一の「最良の」モデルに賭けることはしません。利用可能な最強のモデルと、実際にあなたの働き方を学ぶメモリーシステムを組み合わせています。何を重視し、どのように反復し、通常どこで問題が発生するかを学習します。

それが実際にどのように感じられるか興味があるなら、ぜひご自身で試してみてください。 [Macaronを無料で試す→]