Oltre la Memoria: Verso una Continuità del Sé

L'identità umana e la continuità personale non sono memorizzate in un database; emergono da narrazioni, contesto e cambiamenti nel tempo. Allo stesso modo, il cervello di Macaron evita qualsiasi modello semplicistico di 「carta d'identità」 dell'utente. Non esiste un unico oggetto statico nel sistema etichettato come 「profilo della personalità dell'Utente X」 o un elenco di fatti canonici sull'utente che devono rimanere veri per sempre. Invece, la continuità è trattata come una proprietà emergente di molte piccole interazioni, memorie e adattamenti intrecciati insieme. Questo approccio evita deliberatamente due insidie: fragilità e stagnazione. Un'identità fragile in termini di AI potrebbe verificarsi se il sistema si aggrappasse a fatti una tantum (「l'utente ha detto di apprezzare gli scacchi nel 2022」) e li trattasse come definitivi. Poi, se qualche fatto è errato o cambia (l'utente smette di apprezzare gli scacchi), il modello del sistema si frantuma o diventa incoerente. Un'identità stagnante si verifica se l'AI assume la permanenza degli oggetti per tutti i tratti dell'utente, il che significa che non dimentica mai o aggiorna le informazioni, portando a un modello utente ossificato che non evolve. Il cervello di Macaron evita entrambi non impegnandosi mai completamente in alcun fatto come eterno e permettendo ciò che potremmo chiamare un elegante oblio e riformulazione.

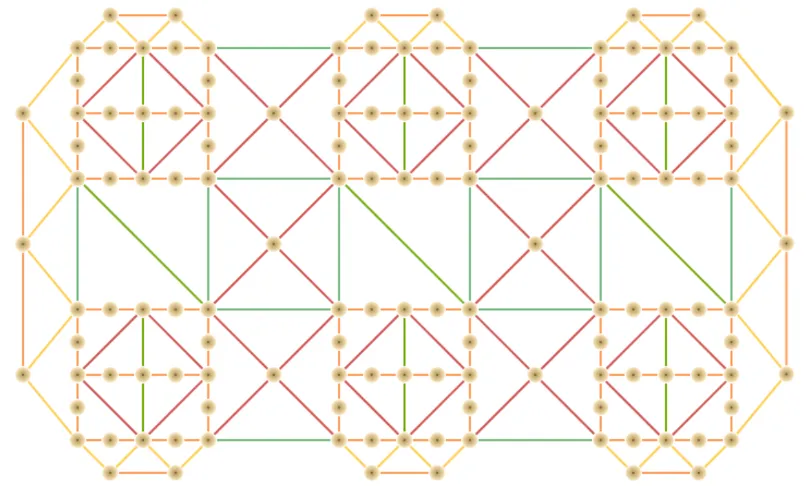

Invece di basarsi sulla permanenza dell'oggetto, Macaron si basa sulla permanenza del contesto: l'idea che ogni contesto o filo di conversazione mantenga coerenza localmente, e la continuità nel tempo sia raggiunta intrecciando insieme questi fili di contesto quando rilevante. Non esiste un singolo 「oggetto」 che rappresenta l'utente e persiste invariato; ci sono rappresentazioni multiple e legate al contesto che possono essere evocate e aggiornate secondo necessità. Questo è analogo a come una persona possa presentarsi diversamente in diversi ambiti sociali, pur avendo una continuità sottostante. Il Cervello di Macaron mantiene l'identità come qualcosa di distribuito e fluido. L'identità non risiede in un nodo di memoria particolare, ma nelle connessioni e nei modelli che persistono attraverso le memorie. In sostanza, la continuità del sé è un racconto emergente, non una voce di database.

Per un esempio concreto, considera come Macaron ricorda le preferenze di un utente. Invece di memorizzare 「Colore preferito dell'utente = blu」 in un profilo, il Cervello di Macaron lo ricorderà nel contesto di conversazioni rilevanti (se l'utente ha parlato di colori in una conversazione di design la settimana scorsa, quella memoria è recuperabile in un contesto di design). Se l'anno prossimo l'utente esprime una nuova preferenza (ora gli piace il verde), il Cervello non ha bisogno di eseguire un aggiornamento distruttivo di un campo canonico. La nuova informazione è semplicemente un altro punto dati nella linea temporale e, quando il contesto di design si ripresenta, la preferenza più recente avrà naturalmente più peso a causa della sua attualità e rilevanza, mentre quella vecchia perde significato. Così, la continuità è mantenuta dando priorità contestuale alle informazioni più recenti e rilevanti, non presumendo che il vecchio fatto fosse 「il vero io permanente」. Il fatto precedente non è perso – è solo de-prioritizzato (maggiori dettagli su questo nel decadimento referenziale). Questo produce un'identità non fragile: nessun singolo dato obsoleto può compromettere la comprensione di Macaron dell'utente, perché la comprensione non si è mai basata su fatti statici, ma su modelli e contesto.

Confini Distribuiti: Molti Sé, Un Sé

Una scelta architettonica notevole nel Cervello di Macaron è l'uso di confini distribuiti per la conoscenza e la memoria. Invece di aggregare tutto ciò che l'AI sa sull'utente in un unico modello centrale o repository, Macaron separa la conoscenza per contesto, origine o confini tematici. Ad esempio, le interazioni relative alla vita professionale dell'utente potrebbero essere mantenute in uno 「spazio vettoriale」 o sottosistema, mentre le conversazioni personali risiedono in un altro, e così via. Questi non sono silos nel senso di essere incapaci di comunicare tra loro, piuttosto sono zone di confine che possono connettersi quando necessario ma non si fondono automaticamente. Questo design rispecchia l'idea psicologica che le persone abbiano molteplici sfaccettature o 「sé」 (sé lavorativo, sé familiare, ecc.), che insieme formano la persona intera ma sono attivati contestualmente.

Attraverso i confini di memoria distribuita, Macaron garantisce che ogni aspetto dell'identità dell'utente sia internamente coerente e non contaminato da informazioni non pertinenti. Ad esempio, se l'utente ha un contesto di 「hobby」 riguardante le preferenze musicali e un altro contesto di 「lavoro」 sulla gestione dei progetti, il sistema non applicherà accidentalmente preferenze musicali informali quando risponde a una domanda formale legata al lavoro, a meno che non sia esplicitamente rilevante. Ciò previene risposte errate o imbarazzanti che mescolano inappropriatamente i contesti. Inoltre, migliora la privacy: le informazioni sensibili di un contesto non sono indiscriminatamente disponibili per altri. Tecnicamente, Macaron raggiunge questo obiettivo creando grafici di conoscenza separati o indici vettoriali per dominio o sessione, simile a quello che fanno le architetture AI personali come Memno — 「ogni utente esiste nel proprio universo」, e all'interno di esso, esistono ulteriori segmentazioni. I dati di ogni utente sono isolati dagli altri (questo è un confine a livello di utente), ma all'interno di un utente, ci sono ulteriori barriere basate sul contesto o sulla fonte dei dati.

Tuttavia, la chiave è che la continuità del sé emerge ancora attraverso questi confini. Il Cervello di Macaron può stabilire connessioni tra memorie specifiche al contesto quando opportuno. Chiamiamo questo processo federazione per rilevanza: se oggi la conversazione dell'utente in un contesto sociale tocca un progetto di cui ha discusso in un contesto lavorativo, Macaron può recuperare intuizioni pertinenti da quel contesto lavorativo – ma lo fa con cautela e consapevolezza del confine (come per citare quella conoscenza proveniente da 「quella discussione sul progetto」). La natura distribuita significa che non esiste un singolo 「profilo principale」 a cui fare riferimento; l'AI deve navigare lungo la rete di contesti per assemblare informazioni identitarie pertinenti al volo. Questo è più complesso dal punto di vista computazionale rispetto a una semplice ricerca in un database unificato, ma offre una continuità più ricca e sensibile al contesto.

È importante che i confini distribuiti supportino anche la nostra posizione sulla privacy e contro il profiling. Non centralizzando il modello dell'utente, Macaron evita intrinsecamente di costruire un profilo comportamentale unificato che potrebbe essere sfruttato o usato in modo improprio (il che è vantaggioso per la libertà e la privacy dell'utente). Ogni contesto può persino essere effimero se lo si desidera – ad esempio, un contesto sensibile potrebbe essere impostato per l'auto-eliminazione dopo l'uso, lasciando solo un riassunto di alto livello nella memoria a lungo termine. Tuttavia, anche se i singoli pezzi svaniscono, l'insieme della narrazione dell'utente rimane intatto attraverso i fili sovrapposti dei contesti rimanenti. Questa è l'essenza di un'identità non fragile: è archiviata in modo ridondante e distribuito. Nessun singolo contesto definisce l'utente, e perdere qualsiasi contesto non cancella il sé.

Decadimento Referenziale: Dimenticare come Caratteristica

Per mantenere la coerenza narrativa senza fossilizzazione, il Cervello di Macaron impiega un concetto che chiamiamo decadimento referenziale. In termini semplici, il decadimento referenziale è una strategia di affievolimento graduale dell'influenza di riferimenti o ricordi specifici nel tempo, a meno che non vengano rafforzati. Invece di una cancellazione rigorosa, le informazioni 「perdono progressivamente」 la loro importanza. Questo trae ispirazione dalla memoria umana: non ricordiamo ogni conversazione parola per parola; i dettagli svaniscono, ma rimangono i modelli importanti. In Macaron, ogni elemento della memoria ha una sorta di peso di età o utilizzo. Ogni volta che viene utilizzato o citato in conversazione, viene rinfrescato (rafforzato). Gli elementi non utilizzati vedono il loro peso attenuarsi lentamente.

L'effetto del decadimento referenziale è che il Cervello di Macaron si concentra su ciò che è rilevante e attuale, allineandosi con il racconto in evoluzione dell'utente. Se un utente ha parlato dell'argomento X due anni fa e non lo ha mai più menzionato, il sistema considererà quell'argomento periferico a meno che l'utente non lo riprenda. Questo evita il comune problema dei sistemi AI che ricordano troppo, portandoli a far emergere dettagli passati irrilevanti e a confondere il flusso della conversazione. Come ha osservato un ricercatore della memoria AI, un'AI con un richiamo perfetto e indiscriminato può diventare come "un amico fastidioso che continua a riportare argomenti poco importanti delle conversazioni passate, incapace di capire che interessi e priorità cambiano". Il decadimento referenziale previene tale comportamento dimenticando funzionalmente le banalità del passato a favore del contesto presente.

L'implementazione tecnica del decadimento referenziale nel Cervello di Macaron potrebbe coinvolgere l'assegnazione di una funzione di decadimento agli embeddings di vettori o ai bordi del grafo di conoscenza. Nel tempo (o dopo molte nuove interazioni), il punteggio di somiglianza o il potenziale di attivazione dei nodi di memoria più vecchi diminuisce. Fondamentalmente, non cancelliamo completamente i ricordi (a meno che non sia richiesto dall'utente); piuttosto, come suggerisce un framework, il sistema conserva un record storico completo ma semplicemente de-prioritizza ciò che è obsoleto. Tutto è ancora lì in un archivio profondo (proprio come probabilmente i nostri cervelli codificano più di quanto possiamo ricordare), ma ciò che è facilmente recuperabile è orientato verso il recente e il frequentemente menzionato. Questo design serve a due scopi: mantiene la coerenza assicurando che i contributi dell'AI riflettano lo stato attuale della vita e delle preferenze dell'utente, e rispecchia anche un importante aspetto dell'autodeterminazione personale – la capacità di andare avanti, cambiare, far sì che le vecchie informazioni diventino meno determinanti.

Da una prospettiva di conformità (collegandosi alla Privacy), il decadimento referenziale si allinea anche con la minimizzazione dei dati. Macaron non spinge aggressivamente i vecchi dati personali in ogni interazione; li utilizza solo quando sono contestualmente rilevanti. Questo riduce il rischio di utilizzo inappropriato di dati passati da tempo. Si potrebbe dire che il Cervello di Macaron attua intrinsecamente una sorta di 「politica di conservazione」 sui dati personali appresi, dimenticando gradualmente ciò che non serve più – pur senza perdere il ricordo del ricordo (possiamo sempre immergerci negli archivi se necessario, proprio come una persona potrebbe, sotto una profonda riflessione, richiamare alla memoria qualcosa a lungo trascurato).

Il beneficio emergente è che l'identità diventa resiliente. Se l'utente cambia drasticamente (nuovo lavoro, nuovo hobby, credenze mutate), il decadimento referenziale permette all'AI di adattarsi senza problemi. Non è necessario un'evidente sovrascrittura di un profilo centrale; le nuove informazioni oscurano naturalmente le vecchie. Tuttavia, se il vecchio contesto diventa rilevante (magari in una conversazione nostalgica anni dopo), Macaron può ancora recuperarlo – così la continuità è preservata in background ma non imposta in primo piano. Questa dinamica di ricordare e dimenticare è fondamentale per la coerenza intertemporale: assicura che la comprensione dell'AI oggi si armonizzi con la realtà odierna, pur mantenendo silenziosamente una narrazione completa in sottofondo.

Intreccio Temporale: Tessere il Tempo nella Memoria

Se il decadimento referenziale gestisce l'oblio, l'intreccio temporale gestisce il ricordo nel tempo. Usiamo il termine 「intreccio」 per evocare come il Cervello di Macaron intreccia più linee temporali di contesto per creare una comprensione coesa. L'esperienza umana è intrinsecamente temporale – la nostra identità è una storia che raccontiamo a noi stessi collegando passato, presente e futuro. Il Cervello di Macaron tenta di simulare questo intrecciando memorie da tempi diversi quando necessario, creando di fatto una narrazione intrecciata.

Immagina che l'utente abbia avuto conversazioni ricorrenti sulla scrittura di un romanzo: una sei mesi fa, un'altra due settimane fa e una oggi. Ogni conversazione è un filo. L'intreccio temporale significa che Macaron può attingere a tutte queste informazioni e presentare una continuità sintetizzata: 「In passato [6 mesi fa] hai detto di preferire scrivere al mattino, e recentemente [2 settimane fa] stavi esplorando temi di fantascienza. Oggi stai chiedendo di pianificare il tempo per scrivere – forse potresti combinare questi spunti: riserva le mattine per scrivere capitoli di fantascienza.」 L'AI non aveva un singolo file di 「progetto romanzo」 esplicito (anche se potrebbe taggare gli argomenti); invece ha intrecciato insieme i pezzi temporalmente separati in un unico filo di discorso. Questo è reso possibile dall'allegare metadati temporali ai ricordi e collegare intenzionalmente elementi correlati nel tempo. L'architettura della memoria di Macaron utilizza indici consapevoli del tempo: i ricordi non sono solo etichettati per argomento ma anche per quando sono accaduti. Questo consente un recupero che può estendersi attraverso diversi periodi ma all'interno dello stesso contesto tematico.

Si può paragonare l'intreccio temporale a mantenere aperte diverse finestre di contesto e poi intrecciarle. Il 「sé attuale」 dell'utente è composto dagli echi dei suoi sé passati, e le risposte di Macaron riflettono quella stratificazione. L'architettura potrebbe impiegare la sintesi o la modellazione narrativa che incorpora esplicitamente il tempo (「precedentemente, nella tua storia…」). Importante è che questo avvenga senza presupporre che il passato sia una verità statica – piuttosto, il passato è trattato come contesto di fondo per informare il presente. Il risultato intrecciato è una continuità più forte: l'utente sente che l'AI ricorda il percorso che ha intrapreso, non solo punti isolati. Tuttavia, a causa del decadimento referenziale, l'intreccio sottolineerà i fili più spessi e freschi (menzioni recenti) rispetto a quelli sbiaditi.

Questo approccio è in linea con la ricerca che suggerisce che l'IA necessita di consapevolezza temporale per mantenere interazioni coerenti a lungo termine. Ad esempio, una proposta è di dotare i sistemi di memoria dell'IA di un senso di validità temporale e di trattare i fatti come se fossero datati, in modo che l'IA possa distinguere tra ciò che è 「non più vero」 e ciò che è 「ancora attuale」. Il Cervello di Macaron adotta questa idea, ad esempio, segnando una conoscenza come 「L'utente vive a Parigi [2019-2023]」 e se nel 2024 l'utente menziona di essersi trasferito a Londra, l'informazione su Parigi viene contrassegnata come obsoleta nel contesto. Poi, nella conversazione, Macaron non confonderà le due informazioni – ma se l'utente ricorda Parigi, quei ricordi sono disponibili. In effetti, Macaron può intrecciare le linee temporali: il sé presente (Londra) e il sé passato (Parigi) coesistono nella narrazione, ma non si confondono. La continuità dell'utente è rappresentata come un arazzo temporale, non come un'unica istantanea.

L'intreccio temporale significa anche che la nozione di verità di Macaron è temporale e contestuale. Non esiste un fatto canonico eterno come potrebbe avere un database; esiste 「ciò che era vero allora」 e 「ciò che è vero ora」 e potenzialmente 「ciò che potrebbe essere vero in futuro」 (se si pianifica o si simulano scenari futuri). Quest'ultimo accenna al prossimo concetto: l'ancoraggio controfattuale.

Ancoraggio Controfattuale: Stabilità Senza Sintesi

Una delle tecniche più speculative ma intriganti nel Cervello di Macaron è l'ancoraggio controfattuale. Questa idea nasce dalla necessità di mantenere coerenza senza fondere tutto in un unico modello utente sintetizzato. Come possiamo garantire che l'AI abbia una percezione stabile dell'utente (il loro stile, le preferenze probabili, i valori) se evitiamo deliberatamente di creare un unico profilo aggregato? La risposta è utilizzare scenari controfattuali per ancorare aspetti chiave della personalità dell'utente nel ragionamento dell'AI, piuttosto che fatti espliciti memorizzati.

In pratica, l'ancoraggio controfattuale potrebbe funzionare così: il Cervello di Macaron, quando genera una risposta o prende una decisione, testa internamente alcune variazioni "e se..." per valutare la coerenza. Per esempio, supponiamo che Macaron stia per suggerire un libro all'utente. L'AI non ha una regola rigida "L'utente ama solo la fantascienza." Invece, potrebbe ricordare diversi segnali del passato: l'utente ha apprezzato alcuni romanzi di fantascienza, ma ha anche menzionato una volta di amare un mistero. Per evitare errori, l'AI potrebbe simulare due output controfattuali: uno in cui assume che l'utente sia in vena di fantascienza, un altro in cui potrebbe preferire un mistero, e vedere quale si allinea meglio con il contesto recente o ottiene una previsione di sentimento positiva. Questo ragionamento controfattuale interno aiuta ad ancorare la scelta dell'AI in una valutazione robusta degli stati possibili dell'utente, piuttosto che in un'ipotesi ristretta. È come se l'AI dicesse: "Non sono sicuro al 100% di chi sei in questo momento, ma se sei ancora il fan della fantascienza che sembravi essere, ti piacerà X; se sei cambiato, potrebbe piacerti Y. Scegliamo il suggerimento che si adatta al tono della conversazione attuale." In effetti, l'AI si sta proteggendo dalla fragilità di un singolo modello di identità esplorando sul momento alternative di identità.

Un altro utilizzo dell'ancoraggio controfattuale è nel mantenere la voce e i valori dell'utente. Macaron evita di sintetizzare un profilo utente unificato che dica 「L'utente è sempre formale」 o 「L'utente ha una posizione politica Z」 – questo sarebbe fragile e possibilmente invasivo. Invece, quando compone un output (ad esempio, redigendo un'email per l'utente), Macaron può generare alcune varianti stilistiche (formale, informale, umoristico) e confrontarle con un modello leggero delle recenti comunicazioni dell'utente per vedere quale si sente più 「in carattere」. Questo funge da ancoraggio: l'AI non memorizza 「L'utente è formale」 in modo permanente, ma può dedurre dal contesto che proprio ora, un tono formale corrisponde alle email della settimana scorsa. Se il mese prossimo lo stile dell'utente cambia, il controllo controfattuale lo rileverà naturalmente e si adatterà, senza bisogno di riscrivere qualche variabile del profilo. La continuità dell'utente è quindi mantenuta da costanti piccoli allineamenti piuttosto che da un unico schema statico.

L'ancoraggio controfattuale è in qualche modo simile a come gli esseri umani navigano l'identità in diverse situazioni: spesso immaginiamo inconsciamente 「come agirei se fossi il tipo di persona che…?」, il che in realtà aiuta a chiarire chi scegliamo di essere. Per Macaron, queste micro-simulazioni assicurano coerenza testando le assunzioni piuttosto che basandosi su di esse. Il risultato è coerenza senza calcificazione: il Cervello di Macaron può agire in modo coerente 「come l'utente di Macaron」 senza mai memorizzare una definizione fissa di 「utente di Macaron」. La coerenza emerge da un allineamento ripetuto e improvvisato.

Coerenza Senza Sintesi Centralizzata

Facendo un passo indietro, la combinazione di confini distribuiti, decadimento referenziale, intreccio temporale e ancoraggio controfattuale servono tutti a un obiettivo principale: mantenere coerenza e continuità senza un modello utente centralizzato o un profilo persona sintetico. Questa è una filosofia deliberata. Molti sistemi AI tentano di costruire profili utente estesi o di perfezionare modelli sui dati di un utente per creare un 「modello personale」. Macaron evita esplicitamente di perfezionare un modello monolitico su tutti i dati utente; invece, mantiene i dati segmentati e utilizza meta-modelli per assemblare risposte. Ci sono alcune ragioni per questa evitazione della sintesi:

Privacy e Fiducia: Un profilo comportamentale centralizzato può diventare un ricettacolo di dati personali e sollevare preoccupazioni sulla privacy (chi vi ha accesso, cosa succede se è errato o utilizzato in modi non intenzionali?). Non avendone uno, Macaron garantisce che ogni dato sia usato solo nel contesto appropriato, e la comprensione del sistema è intrinsecamente decentralizzata. È più vicino al principio della minimizzazione dei dati – utilizzare solo ciò che è necessario quando è necessario, piuttosto che accumulare un profilo maestro.

Evitare l'Overfitting dell'Identità: Le persone sono complesse e mutevoli. Un singolo modello addestrato su tutti i dati passati tenderebbe a sovraddestrarsi sul passato dell'utente, rendendo l'AI meno adattabile al loro futuro. Macaron mantiene il suo nucleo generativo un modello generale arricchito con dati specifici al contesto in tempo reale (stile Retrieval-Augmented Generation). Ciò significa che la 「visione」 di Macaron sull'utente è sempre una funzione delle attuali estrazioni, non una rete statica sovraddestrata. L'utente può reinventarsi e Macaron lo seguirà, perché Macaron non è ancorato al fine-tuning di ieri. In sostanza, preveniamo che l'AI diventi una caricatura del passato dell'utente.

Trasparenza e Controllo: Quando non c'è un singolo modello sintetizzato, è più facile ispezionare e controllare ciò che l'IA utilizza per formare le risposte. Macaron può mostrare, se necessario, quali frammenti di memoria sono stati recuperati per una query, offrendo trasparenza. Se un utente dice "dimentica questo evento," possiamo eliminare quella memoria, rendendola veramente inaccessibile per usi futuri. In un modello sintetizzato centralmente, eliminare un fatto è difficile (non puoi facilmente fare in modo che una rete neurale "disimpari" un dettaglio senza riaddestrarla). Evitando la sintesi centrale, il Cervello di Macaron rimane più modificabile e interpretabile.

Tuttavia, nonostante Macaron non abbia un profilo unificato, riesce a ottenere una sorta di unità: una continuità di personalità. L'IA personale dell'utente risponde in un modo che sembra coerente e unicamente loro. Com'è possibile? Principalmente grazie alle possibilità architettoniche che abbiamo descritto: il sistema recupera dinamicamente i giusti frammenti di memoria e li utilizza per modellare gli output (così il contenuto è personalizzato), e utilizza tecniche come l'abbinamento di stile e i controlli controfattuali per garantire che il tono e l'approccio siano allineati al carattere dell'utente. Altri progetti di IA personale promuovono anche modelli specifici per l'utente che funzionano in isolamento, effettivamente un modello per utente, per garantire la personalizzazione senza condividere dati. L'approccio di Macaron è leggermente diverso: piuttosto che addestrare un modello distinto per utente (che è un'altra forma di centralizzazione, solo per utente), Macaron utilizza un modello di base condiviso con pod di memoria per utente e personalizzazione al volo. Questo produce benefici di personalizzazione simili (i dati di ogni utente sono separati, i modelli possono adattarsi al linguaggio individuale) ma senza la necessità di addestrare o ottimizzare nuovamente per ogni utente, e senza consolidare tutte le conoscenze in pesi difficili da verificare.

Il risultato è un sistema che mantiene la coerenza come se avesse un sé, ma quel 「sé」 non è un singolo oggetto o file: è un fenomeno emergente. Il Cervello di Macaron dimostra che puoi avere i vantaggi di una persona persistente (l'AI 「ricorda」 stile, preferenze, storia) pur mantenendo la fluidità e l'impermanenza che rispettano la vera identità umana. Il sé è sostenuto dalla struttura e dal processo, non da un archivio statico.

Implicazioni per l'Agenzia Personale e l'Identità Digitale

L'architettura del Cervello di Macaron ha implicazioni più ampie. Prima di tutto, potenzia l'agenzia personale. L'utente rimane in controllo della propria narrazione in evoluzione. Poiché l'AI non impone un profilo rigido, l'utente può cambiare abitudini, opinioni, persino aspetti dell'identità, e l'AI si adatterà di conseguenza piuttosto che resistere o insistere con 「Ma una volta hai detto...」. Questa dinamica è cruciale per una sana relazione a lungo termine tra umani e AI. Tratta l'utente come il protagonista in crescita della propria storia, non come un insieme di dati da fissare. L'AI diventa un'impalcatura che supporta la continuità del sé dell'utente, piuttosto che uno specchio che li intrappola in riflessioni passate.

Dal punto di vista della personalità digitale, l'approccio di Macaron suggerisce un modello per ciò che costituisce un 「sé digitale」. Non si tratta di un doppio digitale (non è una copia della persona su un server), ma piuttosto di un processo che si sviluppa nel tempo e nel contesto. Se la società e il diritto arriveranno mai a riconoscere la continuità personale assistita dall'AI – ad esempio, se un'AI potesse essere vista come parte della mente estesa di una persona o addirittura concessa una sorta di personalità dipendente – ciò sarà probabilmente dovuto ad architetture come questa. Dimostrano che un'AI può avere continuità senza un'identità singolare: proprio come una società è una persona giuridica composta da molte parti e processi, un'AI personale potrebbe essere vista come parte dell'identità della persona senza essere un semplice clone di dati.

Curiosamente, lo status legale di tali persone digitali rimane indefinito. Come ha osservato un commentatore, la futura dottrina giuridica dovrà affrontare questioni relative alla personalità digitale e alle responsabilità o diritti associati agli agenti AI che agiscono come parte dell'identità di una persona. Il Cervello di Macaron offre un caso di studio per un approccio responsabile: evitando profili comportamentali centralizzati, aggira molte preoccupazioni etiche e legali (come i pregiudizi nel profiling o l'AI che 「impazzisce」 con informazioni obsolete). Se un giorno un'AI personale venisse considerata per il riconoscimento legale (ad esempio, essere in grado di svolgere autonomamente determinate azioni per conto di un utente), un'architettura che mantenga coerenza attraverso una memoria responsabile piuttosto che modelli di persona imperscrutabili sarà molto più facile da giustificare e fidarsi.

Un'altra implicazione riguarda la continuità dopo la morte o durante lunghe assenze. Se un utente di Macaron diventa inattivo per un anno e ritorna, l'IA può ripristinare la trama della loro identità senza intoppi dalla memoria archiviata (con riferimenti decaduti, ma non eliminati). Se un utente dovesse venire a mancare e la sua famiglia continuasse un dialogo, l'IA non sarebbe la persona (né Macaron cerca di esserlo), ma solleva la domanda: quanta continuità è sufficiente per una presenza significativa? Abbiamo già esempi di avatar digitali di persone care, dove, come ha detto un'analisi dei sé digitali suggeriti, 「la linea tra origine ed eco si dissolve nel dialogo」. Il Cervello di Macaron potrebbe, in teoria, facilitare una sorta di continuità digitale – anche se l'uso etico probabilmente limiterebbe questo beneficio all'utente vivente (ad esempio, aiutandoti a ricordare in modo coerente gli eventi della tua vita negli anni successivi).

Infine, non finalizzando l'utente in un profilo, il design di Macaron riconosce implicitamente una posizione filosofica: l'identità è costruita, in continua evoluzione e legata al contesto. Questo risuona con le visioni postmoderne secondo cui non esiste un io immutabile, ma solo un io narrativo. In questo senso, il Cervello di Macaron è un motore narrativo. Per gli utenti, questo può essere liberatorio: significa che la loro IA evolve con loro, co-creando una narrazione piuttosto che imporne una. Significa anche che l'IA può facilitare l'auto-scoperta: poiché può notare schemi (「Nei nostri dialoghi sul lavoro e sulla vita personale, parli spesso con passione di equità」), ma non li afferma come verità statiche, può riflettere delicatamente i valori apparenti dell'utente e lasciare che l'utente li confermi o ridefinisca. L'utente rimane l'autore; l'IA è un editor molto sofisticato e un tracciatore di continuità.

Conclusione

Dal substrato al sé – abbiamo percorso un viaggio dai meccanismi di memoria sottostanti di Macaron all'emergere di un 「sé」 personale continuo supportato dall'architettura del Brain. Abbiamo visto che la continuità non deve necessariamente provenire da un archivio permanente di fatti o da un modello utente monolitico. Invece, Macaron si affida a un approccio più organico: ricordi che svaniscono a meno che non vengano rinnovati, confini che compartimentano le esperienze ma permettono interazioni, il tempo trattato come una dimensione della conoscenza e il ragionamento controfattuale per ancorare le decisioni in una comprensione flessibile dell'utente. Il risultato è un'intelligenza artificiale personale che è coerente ma non limitante, coerente ma non statica.

Questa è stata un'esplorazione necessariamente teorica, perché tale comportamento di ordine superiore è all'avanguardia del design di intelligenza artificiale personale. Tuttavia, è radicata in principi concreti: privacy (nessun profilo centralizzato), funzione di memoria simile a quella umana (ricordare e dimenticare) e apprendimento adattivo. Il Brain di Macaron evita di centralizzare modelli utente o profili comportamentali non solo per la privacy, ma perché non è così che funziona la vera continuità personale. Mantenendo la coerenza senza sintesi, Macaron assicura che sia l'utente a tessere il filo della continuità, mentre l'IA fornisce il telaio e le mani gentili che guidano i fili.

Guardando al futuro, mentre gli AI personali diventano più diffusi, potremmo scoprire che solo quelli progettati con questa fluidità di continuità guadagneranno la fiducia a lungo termine degli utenti. Un AI che non dimentica mai e non cambia mai sarebbe inquietante; uno che dimentica troppo, frustrante. L'aspirazione di Macaron è di trovare il giusto equilibrio: ricordare ciò che conta, dimenticare ciò che non serve e accompagnare l'utente nel tempo come un partner fedele ma in evoluzione. In questo modo, ci avviciniamo a una visione in cui i sistemi digitali rispettano e rafforzano la continuità del sé, piuttosto che frammentarla o congelarla. La serie Brain ha tracciato questa visione: dal rifiuto della metafora del database, alla costruzione di un substrato dinamico, alla coltivazione di qualcosa che inizia ad assomigliare a un 「sé」. Le implicazioni continueranno a svilupparsi, ma una cosa è chiara: la strada verso un AI personale che arricchisca veramente la vita umana risiede nell'abbracciare la complessità dell'identità e della memoria, progettando per il cambiamento e la continuità insieme. Il Brain di Macaron è un esperimento continuo in quella direzione, un'impalcatura per un sé che rimane tuo, anche mentre cresce con te.